搜索到

21

篇与

的结果

-

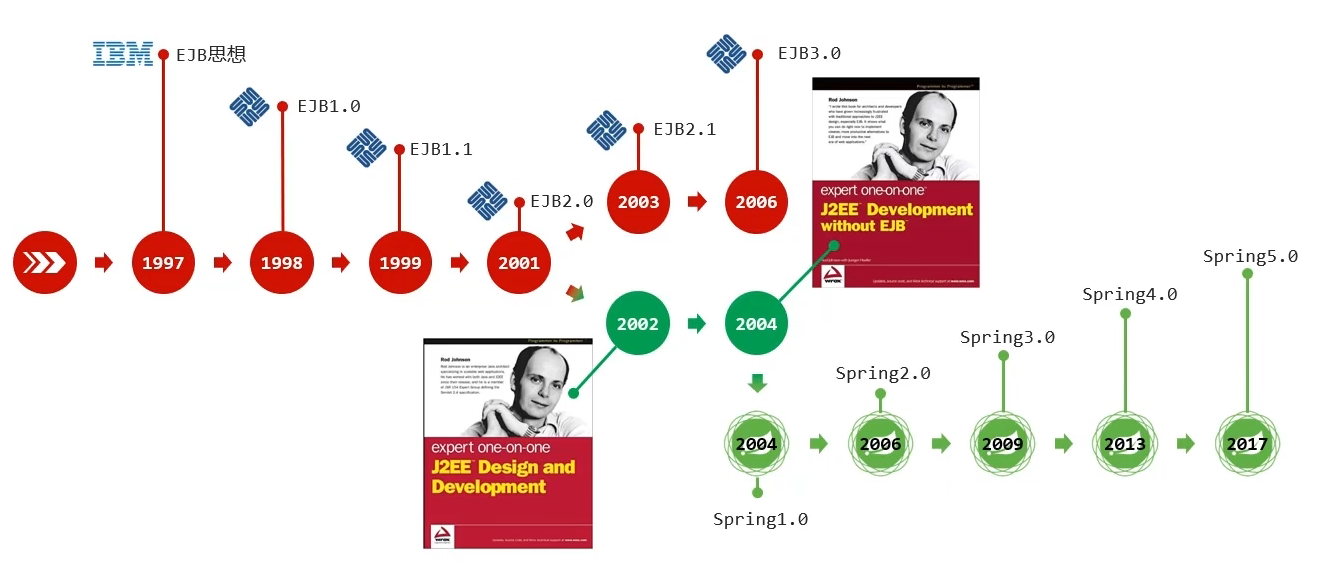

不使用 MySQL Installer 安装 MySQL 的方法 目录: 1、下载安装MySQL 2、在安装目录新建配置 3、添加环境变量 4、安装 5、启动服务 6、卸载 现在 Windows 下安装 MySQL 的时候需要首先下载 MySQL Installer,通过这个软件来联网安装管理不同版本的 MySQL,但是这个软件默认是将 MySQL 安装在 C 盘的,修改安装路径的地方也藏的很隐蔽,并且由于安装时 MySQL Installer 需要联网下载安装包,这对于内网里的机器无疑就是很不友好的。但是从 Oracle 官网下载到的 MSI Installer 程序只是解压出了 MySQL 程序,并没有进行任何的环境变量配置、服务配置,那么就需要通过手动配置程序信息。 1、下载安装MySQL 最新版本下载链接:MySQL :: Download MySQL Community Server 旧版本下载链接:MySQL :: Download MySQL Community Server (Archived Versions) 选择下载某一个版本的 MSI 安装程序或者 ZIP 压缩包,下载完成之后进行安装或解压。 2、在安装目录新建配置 下文中的 MySQL 安装目录以 D:\Program\Environment\MySQL\MySQL Server 5.7 为例: 安装目录下创建一个 “data” 文件夹 安装目录下创建一个 “my.ini” 文本文件,向其中写入以下内容(文件路径根据实际修改): [mysqld] # mysql 安装目录 basedir="D:\Program\Environment\MySQL\MySQL Server 5.7" # mysql 数据库的数据存放目录 datadir="D:\Program\Environment\MySQL\MySQL Server 5.7\data" sql_mode=NO_ENGINE_SUBSTITUTION,STRICT_TRANS_TABLES # MySQL服务器监听的端口 port=3306 # 服务端编码方式 character-set-server=utf8mb4 [clinet] # 客户端编码方式 loose-default-character-set=utf8mb4 # 端口号设置 port=3306 [WinMySQLadmin] Server="D:\Program\Environment\MySQL\MySQL Server 5.7\bin\mysqld.exe" 3、添加环境变量 右键 “开始菜单” -> “系统” -> “高级系统设置” -> “环境变量” 向 Path 中添加环境变量,值为 MySQL 安装目录下的 bin 文件夹: D:\Program\Environment\MySQL\MySQL Server 5.7\bin 4、安装 上面环境变量配置没有问题的话,就可以在 cmd 窗口中使用 mysqld 命令了。 此时以管理员身份运行 cmd 窗口,执行命令来初始化相关 data 文件: # 在前面配置好的 data 文件夹下会生成初始化的文件 mysqld --initialize-insecure --user=mysql 安装 MySQL 服务: mysqld -install 5、启动服务 可以通过以下命令启动 MySQL 服务: net start mysql 或者在 ”服务“ 窗口中找到 ”MySQL“ 这项服务,右键启动即可: 服务窗口可通过在“运行”窗口输入 “services.msc” 来启动,或者右键 开始菜单 -> 计算机管理 -> 服务和应用程序 -> 服务 找到。 在启动过程中有可能会出现报错: 在 MySQL 的服务属性中可以看到这项服务可执行文件的程序路径是不正确的: 这个窗口里面没有提供可以改这个路径的地方,查了一下,得需要到注册表中改,在注册表中(Win + R 运行窗口中输入“regedit”回车打开)找到 “HKEY_LOCAL_MACHINE\SYSTEM\CurrentControlSet\services\MySQL” 这个路径,修改其中 ImagePath 的值,将引号里的路径替换为本地 MySQL 安装文件的实际路径(就只替换前面的路径,其他的不用改): 保存退出之后,再到 “服务” 窗口中刷新一下,可执行文件的路径变成了新的路径之后再次启动即可成功启动 MySQL 服务。 目前本地运行的 MySQL 服务用 root 用户就可以登录,密码为空 MySQL 修改密码: 连接到数据库之后用 SQL 语句为 root 用户更改密码: alter user '用户名'@'localhost' identified by '新密码'; 修改完之后,刷新权限信息: flush privileges; 也可以在 MySQL 控制台中使用 mysqladmin 命令修改用户密码: # 新密码不需要加引号,否则会报错 mysqladmin -u [用户名] -p password [新密码]; 6、卸载 以管理员身份执行命令: mysqld -remove 删除服务: sc delete mysql 删除注册表文件: HKEY_LOCAL_MACHINE\SYSTEM\CurrentControlSet\services\eventlog\Application\MySQL HKEY_LOCAL_MACHINE\SYSTEM\ControlSet001\services\MySQL HKEY_LOCAL_MACHINE\SYSTEM\ControlSet001\services\eventlog\Application\MySQL 参考资料: MySQL8.0绿色版本——最纯净的安装体验(免去卸载不掉只能重做系统的‘囧‘境)_mysql8.0 绿色安装-CSDN博客 mysql 启动提示:错误2系统找不到指定文件;(本地计算机上的mysql服务启动后停止,某些服务在未由其他服务或程序使用时将自动停止)_无法编辑imagepath-CSDN博客

不使用 MySQL Installer 安装 MySQL 的方法 目录: 1、下载安装MySQL 2、在安装目录新建配置 3、添加环境变量 4、安装 5、启动服务 6、卸载 现在 Windows 下安装 MySQL 的时候需要首先下载 MySQL Installer,通过这个软件来联网安装管理不同版本的 MySQL,但是这个软件默认是将 MySQL 安装在 C 盘的,修改安装路径的地方也藏的很隐蔽,并且由于安装时 MySQL Installer 需要联网下载安装包,这对于内网里的机器无疑就是很不友好的。但是从 Oracle 官网下载到的 MSI Installer 程序只是解压出了 MySQL 程序,并没有进行任何的环境变量配置、服务配置,那么就需要通过手动配置程序信息。 1、下载安装MySQL 最新版本下载链接:MySQL :: Download MySQL Community Server 旧版本下载链接:MySQL :: Download MySQL Community Server (Archived Versions) 选择下载某一个版本的 MSI 安装程序或者 ZIP 压缩包,下载完成之后进行安装或解压。 2、在安装目录新建配置 下文中的 MySQL 安装目录以 D:\Program\Environment\MySQL\MySQL Server 5.7 为例: 安装目录下创建一个 “data” 文件夹 安装目录下创建一个 “my.ini” 文本文件,向其中写入以下内容(文件路径根据实际修改): [mysqld] # mysql 安装目录 basedir="D:\Program\Environment\MySQL\MySQL Server 5.7" # mysql 数据库的数据存放目录 datadir="D:\Program\Environment\MySQL\MySQL Server 5.7\data" sql_mode=NO_ENGINE_SUBSTITUTION,STRICT_TRANS_TABLES # MySQL服务器监听的端口 port=3306 # 服务端编码方式 character-set-server=utf8mb4 [clinet] # 客户端编码方式 loose-default-character-set=utf8mb4 # 端口号设置 port=3306 [WinMySQLadmin] Server="D:\Program\Environment\MySQL\MySQL Server 5.7\bin\mysqld.exe" 3、添加环境变量 右键 “开始菜单” -> “系统” -> “高级系统设置” -> “环境变量” 向 Path 中添加环境变量,值为 MySQL 安装目录下的 bin 文件夹: D:\Program\Environment\MySQL\MySQL Server 5.7\bin 4、安装 上面环境变量配置没有问题的话,就可以在 cmd 窗口中使用 mysqld 命令了。 此时以管理员身份运行 cmd 窗口,执行命令来初始化相关 data 文件: # 在前面配置好的 data 文件夹下会生成初始化的文件 mysqld --initialize-insecure --user=mysql 安装 MySQL 服务: mysqld -install 5、启动服务 可以通过以下命令启动 MySQL 服务: net start mysql 或者在 ”服务“ 窗口中找到 ”MySQL“ 这项服务,右键启动即可: 服务窗口可通过在“运行”窗口输入 “services.msc” 来启动,或者右键 开始菜单 -> 计算机管理 -> 服务和应用程序 -> 服务 找到。 在启动过程中有可能会出现报错: 在 MySQL 的服务属性中可以看到这项服务可执行文件的程序路径是不正确的: 这个窗口里面没有提供可以改这个路径的地方,查了一下,得需要到注册表中改,在注册表中(Win + R 运行窗口中输入“regedit”回车打开)找到 “HKEY_LOCAL_MACHINE\SYSTEM\CurrentControlSet\services\MySQL” 这个路径,修改其中 ImagePath 的值,将引号里的路径替换为本地 MySQL 安装文件的实际路径(就只替换前面的路径,其他的不用改): 保存退出之后,再到 “服务” 窗口中刷新一下,可执行文件的路径变成了新的路径之后再次启动即可成功启动 MySQL 服务。 目前本地运行的 MySQL 服务用 root 用户就可以登录,密码为空 MySQL 修改密码: 连接到数据库之后用 SQL 语句为 root 用户更改密码: alter user '用户名'@'localhost' identified by '新密码'; 修改完之后,刷新权限信息: flush privileges; 也可以在 MySQL 控制台中使用 mysqladmin 命令修改用户密码: # 新密码不需要加引号,否则会报错 mysqladmin -u [用户名] -p password [新密码]; 6、卸载 以管理员身份执行命令: mysqld -remove 删除服务: sc delete mysql 删除注册表文件: HKEY_LOCAL_MACHINE\SYSTEM\CurrentControlSet\services\eventlog\Application\MySQL HKEY_LOCAL_MACHINE\SYSTEM\ControlSet001\services\MySQL HKEY_LOCAL_MACHINE\SYSTEM\ControlSet001\services\eventlog\Application\MySQL 参考资料: MySQL8.0绿色版本——最纯净的安装体验(免去卸载不掉只能重做系统的‘囧‘境)_mysql8.0 绿色安装-CSDN博客 mysql 启动提示:错误2系统找不到指定文件;(本地计算机上的mysql服务启动后停止,某些服务在未由其他服务或程序使用时将自动停止)_无法编辑imagepath-CSDN博客 -

Redis进阶学习笔记 目录: 一、Redis 的基础知识 1.1、什么是 Redis 1.2、为什么要有 Redis 二、内存管理与淘汰机制 2.1、内存过期策略 2.2、内存淘汰机制 三、持久化 3.1、RDB 持久化 3.2、AOF 持久化 3.3、RDB-AOF 混合持久化(Redis 4.0) 四、Redis集群方案 4.1、单机模式(Standalone) 4.2、主从复制(Replication) 4.3、哨兵模式(Redis Sentinel) 4.4、Redis Cluster 五、应用场景 5.1 数据库 5.2 系统缓存 5.3 消息队列 5.4 计数器和排行榜 5.5 分布式锁 六、缓存相关问题 6.1、缓存穿透 6.2、缓存击穿 6.3、缓存雪崩 Redis 官网:Redis - The Real-time Data Platform 一、Redis 的基础知识 1.1、什么是 Redis Redis(REmote DIctionary Server)是一个开源的、基于内存的、键值对(Key-Value)数据库,它支持多种数据结构,并提供原子操作、事务、Lua脚本、发布订阅等高级特性。 Redis 支持的基础数据类型有五种: 数据类型 介绍 底层实现 特点 String(字符串) 最基础、最常用的数据类型 SDS(简单动态字符串) 可以存储:字符串、整数、浮点数、二进制数据单个数据最大支持 512MB支持原子操作(如自增、自减) List(列表) 本质是一个双向链表 压缩列表 / 双向链表 有序、可重复支持从两端插入/弹出操作时间复杂度:头尾 O(1) Hash(哈希) 类似于 Map<String, String> 压缩列表 / 哈希表 存储键值对集合(field-value)适合存储对象支持单字段读写 Set(集合) 无序、不 哈希表 / 整数集合 自动去重支持集合运算(交集、并集、差集) ZSet(Sorted Set,有序集合) 在 Set 基础上增加了一个 score(分数) 用来排序 跳跃表 + 哈希表 元素唯一,但 score 可重复按 score 自动排序(底层是跳跃表 + 哈希表)查询效率高(范围查询) 还有几种基于基础数据类型的扩展类型: 数据类型 介绍 特点 Bitmap(位图) 基于 String 的按位操作 每一位是 0 或 1非常节省空间(适合大规模布尔状态) HyperLogLog 用于基数统计(去重计数)的概率算法 占用极小内存(≈12KB)有一定误差(约 0.81%) Geospatial(地理位置) 用于存储地理位置信息 基于 Sorted Set 实现支持距离计算、范围搜索 Stream(流,Redis 5+) 类似消息队列,但功能更强 支持消费组(Consumer Group)支持消息持久化可回溯消息 1.2、为什么要有 Redis 传统关系型数据库(如 MySQL)擅长复杂查询和事务,但磁盘 I/O 导致高并发下存在延迟高、吞吐低的问题,因此数据库的读写性能往往会成为瓶颈。 而加入 Redis 作为高性能缓存,将使用频率高的数据(热点数据)放在内存中,需要时可以直接通过请求 Redis 获取,只有当 Redis 获取不到时才会查询数据库,这种方式可以降低数据库的压力,同时还显著提升系统的响应速度和吞吐量。 Redis 的主要优势包括: 基于内存:所有数据存储在内存中,读写也基于内存操作,避免了磁盘 I/O,因此速度极快,这是最根本的原因; 单线程模型(核心I/O线程): 准确来讲,Redis 不是完全单线程,Redis 6.0 之后,网络I/O、持久化会使用多线程,但命令执行依然是单线程; 在进行读写操作时,单线程可以避免多线程的上下文切换和竞争(锁竞争、死锁)带来的额外开销,反而提升了处理速度,此时的瓶颈不在CPU,而在内存和网络; 并且由于单线程没有了复杂的同步机制,因此也不易出错; I/O多路复用机制:让单线程能同时监听多个 socket 连接,当某个连接有数据请求时,才去处理。类似于一个服务员同时服务很多桌客人,谁举手就去谁那。使用了epoll等高效机制; 高效的数据结构:底层针对不同场景设计了极致优化的数据结构。 二、内存管理与淘汰机制 Redis 是内存数据库,随着应用的运行,如果不清理,Redis 中的 Key 会不断增加,最终内存耗尽导致 OOM(Out Of Memery)。 针对于内存溢出问题,Redis 通过内存过期策略预防内存溢出,而当内存使用达到 maxmemory 上限导致新 Key 无法写入时,Redis 使用内存淘汰机制淘汰旧数据为新数据腾出空间。 2.1、内存过期策略 Redis 通过为 Key 设置过期时间(TTL)来管理内存中的数据生命周期。当 Key 的过期时间到达时,Redis 会自动删除该键及其对应的值,以避免旧数据的无限累计。 内存过期策略主要包括: 定时删除:为每个设置过期时间的 Key 维护一个定时器,当过期时间到达时立即删除。但这种方式会消耗大量的CPU资源,比较影响性能。 惰性删除:在访问 Key 时才检查其是否过期,如果过期则删除。这种方式不会额外消耗CPU资源,但可能导致内存中存在大量过期的 Key,占用内存空间。 需要说明的是,Redis 并不是在 Key 到期的一瞬间就立刻将其从内存中删除,而是采用了定时删除与惰性删除两种策略的组合: Redis 内部开了一个定时任务,默认每段时间(比如 100ms)运行一次; 从设置了过期时间(TTL)的 Key 中随机抽取 20 个数据进行检查; 如果这 20 个 Key 中过期的 Key 占比超过 25%(即超过 5 个),Redis 会认为当前内存中过期 Key 较多,不会等待下一个 100ms,而是立即重复上一个步骤继续抽查、继续清理,直到过期的 Key 占比低于 25%。 内存过期策略也有可能会导致一个问题,如果同一时刻大量数据过期或者 Redis 无法提供服务,客户端请求从 Redis 中获取不到已过期的数据就会查询数据库,从而使数据库请求激增,压力过大造成数据库服务器宕机,即缓存雪崩。 所以要避免大量数据在同一时刻过期,解决办法是在固定过期时间上增加一个随机偏移量,同时对于热点数据,不设置过期时间,使其达到“物理”上的永不过期,可以避免缓存击穿问题。 2.2、内存淘汰机制 当内存使用达到 maxmemory 上限,且新数据写入时,触发淘汰策略,根据配置的内存淘汰策略删除部分键值对以释放内存。 那么应该选择哪些数据淘汰,大致的思想有两种: LRU(Least Recently Used)是按照最近最少使用原则来筛选数据,即最不常用的数据会被筛选出来; LFU(Least Frequently Used)是 Redis4 新增的淘汰策略,它根据 key 的最近访问频率进行淘汰,即访问次数最少的数据会被筛选出来。 再结合淘汰数据的范围(全部 Key 或设置了过期时间的 Key),那么综合考虑下来内存淘汰策略就有八种: 策略 描述 适用场景 noeviction 默认策略。不淘汰,写请求直接返回错误(如SET失败) 数据绝不能丢的场景,如作为数据库 allkeys-random 从所有key中随机淘汰 缓存数据访问频率相近 allkeys-lru 从所有数据中淘汰最近最少使用(LRU)的key 通用缓存,希望保留最可能被再次访问的数据 allkeys-lfu(Redis4.0) 从所有数据中淘汰使用频率最低(LFU)的key 通用缓存,希望保留经常被访问的数据 volatile-ttl 从设置了过期时间的key中,淘汰将要过期的key 通用缓存,希望优先淘汰快过期的数据 volatile-random 从设置了过期时间的key中,随机淘汰key 缓存数据访问频率相近 volatile-lru 从设置了过期时间的数据中淘汰最近最少使用(LRU)的key 通用缓存,希望保留最可能被再次访问的数据 volatile-lfu(Redis4.0) 从设置了过期时间的数据中淘汰使用频率最低(LFU)的key 通用缓存,希望保留经常被访问的数据,比LRU更精准 结合内存过期策略来说,如果此时设置的淘汰策略是 allkeys-lru 或 allkeys-random,那么即使某个 Key 还没到过期时间,也可能被提前淘汰,使用 volatile-lru 或 volatile-ttl 策略,即只针对有过期时间的 Key 进行淘汰,就可以解决这个问题。 三、持久化 对于 Redis 来说,由于数据都在内存中,如果发生断电或进程崩溃时就必然面临数据丢失的风险,因此有了数据的持久化,以便在 Redis 重启后能恢复数据。 Redis 支持的持久化方式有三种:RDB 持久化、AOF 持久化和 RDB-AOF 混合持久化。 3.1、RDB 持久化 RDB(Redis Database)是 Redis 默认采用的持久化方式,它的原理是 Redis 在后台 fork(复制)一个子进程,子进程将该时间的内存数据生成快照文件写入到磁盘中,创建一个经过压缩的 “.rdb” 二进制文件,存储各个数据库的键值对数据等信息。 RDB 持久化的触发方式有两种: 手动触发:通过 SAVE 或 BGSAVE 命令触发 RDB 持久化操作,创建“.rdb”文件; 自动触发:通过配置选项,让服务器在满足指定条件时自动执行 BGSAVE 命令。 RDB 持久化的优缺点: 优点:RDB生成紧凑压缩的二进制文件,体积小,恢复数据的速度非常快; 缺点:RDB 持久化没办法做到实时,BGSAVE 每次运行都要执行 fork 操作创建子进程,属于重量级操作,不宜频繁执行。 3.2、AOF 持久化 AOF 持久化的原理是记录了每次写入命令到 “.aof” 格式的文本文件,类似MySQL的binlog,当 Redis 重启时再重新执行 AOF 文件中的命令来恢复数据到内存中。 AOF的工作流程包括:命令写入(append)、文件同步(sync)、文件重写(rewrite)、重启加载(load)。 需要控制命令同步到硬盘的频率,即多久将命令写入到 AOF 文件中一次,就是同步策略 (appendfsync): appendfsync always:每次写操作后立即同步到磁盘。最安全,但性能最差; appendfsync everysec:每秒同步一次。折中方案,默认推荐,最多丢1秒数据,性能和安全平衡最好; appendfsync no:由操作系统决定同步时机。最快,但最不安全,但可能丢大量数据。 AOF 重写(Rewrite)机制:为了解决文件越来越大的问题,Redis会自动(或手动 BGREWRITEAOF)在后台重写 AOF 文件。只保留“当前数据集的最小命令集合”,去掉冗余操作(比如多次 SET 同一个 Key,只留最后一次)。重写操作由子进程完成,不会阻塞主进程。 AOF 持久化的优缺点: 优点: 数据安全性高,最多丢失一秒的数据; 生成的 “.aof” 格式的日志文件可读,便于调试和修复。 缺点: 文件通常比RDB大,恢复数据慢(因为需要逐条重新执行命令); 对性能有一定影响(尤其是 always 策略)。 3.3、RDB-AOF 混合持久化(Redis 4.0) RDB 持久化和 AOF 持久化都有各自鲜明的优缺点,因此从 Redis4.0 开始引入集成二者优点的持久化方式:RDB-AOF 混合持久化,这种方式的原理是将内存数据先以 RDB 格式写入一个快照到 AOF 文件头部,后续再把写命令追加到快照后面,恢复时先恢复数据的快照,再执行后面的追加命令。 与 AOF 持久化类似,RDB-AOF 混合持久化也具备同步策略和重写机制。 优势:兼顾了 RDB 持久化的加载速度和 AOF 持久化的数据安全,是 Redis 生产环境的首选方案。 四、Redis集群方案 4.1、单机模式(Standalone) 一台服务器上运行一个Redis实例(redis-server)。数据全部放在一台机器的内存里,所有读写操作都经过这个实例,没有任何备份或扩展。 优点:部署简单,适合开发、测试、小型项目;且性能最好,因为没有网络复制开销 缺点:机器宕机、Redis进程崩溃,都会导致服务完全不可用;数据量超过单机内存或 QPS 过高,就扛不住。 4.2、主从复制(Replication) 一个主节点(Master)负责处理写请求,多个从节点(Replica / Slave)实时复制主节点(Master)的数据,只负责处理读请求。整个集群的数据流向是单向的:Master -> Slave。 优点:结构简单,配置容易;从节点分担主节点读压力,极大提升 QPS 缺点:所有写操作都依赖主节点,写性能上限受限于主节点,无法水平扩展写能力;主节点故障需要人工干预切换,无法自动故障转移;异步复制可能导致轻微数据不一致 4.3、哨兵模式(Redis Sentinel) 哨兵模式基于主从模式扩展,主要解决主从模式中主节点(Master)宕机无法自动恢复的问题,以实现高可用。 在主从架构的基础上,引入一组独立的 Sentinel(哨兵)节点。Sentinel 不处理业务读写,只负责心跳检测主从节点,当主节点故障(客观下线),哨兵通过 Raft 协议投票选出一个新的主节点,并通知客户端和其他从节点。 主观下线与客观下线:一个 Sentinel 认为节点挂了是主观下线,半数以上 Sentinel 认为挂了才是客观下线,避免网络误判。 哨兵节点的数量至少为 3 个,且为奇数个,以避免脑裂问题,总体架构推荐至少 3 Sentinel + 1 Master + 2+ Replica。 优点:保留了主从模式的优点,依然支持读写分离,从节点分担读压力;实现了故障自动检测和切换 缺点:本质上还是主从模式,写性能上限受限于主节点,依然无法水平扩展写能力;且主从切换过程中,Redis 会短暂不可用 4.4、Redis Cluster Redis Cluster 是 Redis 官方提供的分布式解决方案,自 Redis 3.0 引入,旨在通过分片(Sharding)技术将数据分布在多个主节点上,解决单机写瓶颈和内存容量瓶颈。 Redis Cluster 将整个数据集分成 16384 个哈希槽(Hash Slot)。每个键通过 CRC16(key) % 16384 计算后,决定落在哪个槽位。集群中存在多个主节点(Master),每个主节点负责一段连续的槽位区间(如 0-5000、5001-10000、10001-16383),并且可挂载一个或多个从节点(Replica)作为数据备份实现高可用。节点之间通过 Gossip 协议相互通信,自动发现新节点、传播故障信息、协调槽位迁移。客户端连接任意一个节点,若请求的数据不在当前节点,节点会返回正确的目标节点地址(MOVED 重定向),智能客户端根据新的目标节点地址自动跳转到正确的节点。 优点: 数据容量水平扩展:总数据量不再受限于单机内存,集群总容量随节点增加而线性增长 写性能水平扩展:写操作分散到多个主节点,增加节点即可线性提升写吞吐量,彻底突破单机写瓶颈 内置高可用:主节点故障自动转移,无需人工干预,比哨兵 Sentinel 更快 故障隔离更好:单个节点故障只影响部分数据,只影响它负责的槽位,其他数据仍可正常读写 缺点: 复杂度高:搭建、监控、运维更麻烦(需要处理 slot 迁移、热点 slot 等) 客户端要求高:必须用支持Cluster的客户端(Redisson、go-redis等),否则需要处理MOVED重定向 批量操作受限:不支持跨节点的事务、和多 Key 操作(除非 Key 带有相同的 {hashtag},强制将其分配到同一槽位) 资源消耗更高:至少6个节点起步 数据倾斜风险:热点key可能集中在某个节点,需要优化key设计 五、应用场景 5.1 数据库 Redis 可以作为主数据库使用,适用于对性能要求高、数据量相对较小的场景,如会话存储、实时排行榜等。 5.2 系统缓存 Redis 最常见的用途是作为缓存层,通过缓存热点数据,可以减少对数据库的查询次数,减轻数据库负担,显著提高应用访问速度。 5.3 消息队列 Redis 的列表和发布/订阅模式可以用于实现消息队列: 通过列表(List)的 LPUSH 和 RPOP 命令可以实现简单的消息队列功能 通过发布/订阅模式可以实现更复杂的消息分发和订阅功能 5.4 计数器和排行榜 Redis 的原子操作和有序集合(ZSet)非常适合实现计数器和排行榜功能,通过为每个元素关联一个分数,可以方便地实现排序和统计功能,如网站访问统计、游戏积分榜等。 5.5 分布式锁 Redis 的原子性操作可以用于实现分布式锁。通过 SETNX 命令可以尝试获取锁,如果获取成功则执行临界区代码;执行完毕后通过 DEL 命令释放锁,保证在分布式环境下的互斥访问。为了避免死锁,还可以为锁设置过期时间。 六、缓存相关问题 在高并发系统中,使用 Redis 做缓存时,最容易引发系统故障的三大“杀手”就是缓存穿透、缓存击穿和缓存雪崩。 6.1、缓存穿透 客户端请求的数据在 Redis 中不存在(缓存未命中),同时在数据库中也不存在。每次请求都会直接打到数据库。如果是恶意构造的大量无效请求(比如 userId = -1、随机长字符串、已删除的商品 ID),数据库瞬间就被打崩。 核心特点: 查询的是“根本不存在”的数据。 缓存和数据库都无法命中,请求每次都穿透。 极易被恶意攻击利用(也叫恶意穿透)。 常见场景: 接口未做参数校验,攻击者用不存在的 ID 疯狂刷接口。 查询已下架或从未存在过的商品 / 用户详情。 解决方式: 接口层参数校验(第一道防线):对请求参数做基础合法性检查(格式、长度等),提前过滤无效请求 缓存空对象(空值缓存)(最常用、简单有效):当数据库返回 null/空时,也在 Redis 中缓存一个空结果,并设置较短的过期时间(建议 30 秒 ~ 5 分钟,避免长期占用内存) 布隆过滤器(Bloom Filter):在 Redis 前加一层布隆过滤器,提前判断该 Key 是否可能存在,如果肯定不存在,直接返回 null,不查 Redis 和数据库,如果可能存在,再走正常缓存流程。 6.2、缓存击穿 某个高并发热点 Key 的缓存突然过期(或被删除),而此时有大量并发请求同时到达。所有请求发现缓存 miss,同时去查数据库,导致数据库瞬时压力暴增,甚至宕机。 核心特点: 问题发生在单个热点 Key 过期瞬间。 查询的是真实存在且非常热门的数据。 影响虽然是单个 Key,但并发量极大,破坏力强。 常见场景: 秒杀商品的库存/详情 Key 刚好过期。 热门新闻、明星话题、爆款商品的缓存到期。 大促期间某个热卖品的缓存失效。 解决方式(核心:只让一个请求去查数据库,其他等待或用旧数据): 缓存未命中时,先尝试获取分布式锁。只有拿到锁的线程才允许查询数据库,其他线程等待或短暂重试。 不依赖 Redis 的原生 expire,而是把“过期时间”字段存到 Value 里(例如 JSON 中加一个 expireTime)。用户请求时,如果发现逻辑已过期,后台异步线程去刷新数据,用户先返回旧数据 热点数据永不过期 + 后台刷新 对极重要热点 Key 不设过期时间,或设很长 TTL,由定时任务/消息队列后台定期刷新 6.3、缓存雪崩 大量缓存 Key 在同一时间段内集体过期(或 Redis 实例宕机),导致海量请求同时穿透到数据库,数据库压力骤增,甚至引发连锁反应导致系统雪崩。 核心特点: 影响的是大量 Key(而非单个)。 通常发生在同一时刻大量 Key 同时失效。 后果最严重,可能导致整个服务不可用。 常见场景: 所有 Key 统一设置相同过期时间(如全设 30 分钟)。 大促活动结束,大量活动缓存同时到期。 Redis 重启或故障(无持久化时,所有缓存瞬间丢失)。 解决方式: 最简单、最有效:设置过期时间时加上随机偏移,避免大量 Key 同时到期 缓存预热 + 永不过期策略:提前把热点数据加载到缓存;核心数据可永不过期,由后台异步更新 多级缓存:第一层用 Caffeine/Guava 本地缓存挡住大部分请求,Redis 作为二级,数据库作为最后防线 熔断降级 + 限流 + 快速失败:使用 Sentinel / Hystrix / Resilience4j 等框架:当数据库压力过大时,快速熔断,返回兜底数据(“系统繁忙,请稍后重试”或缓存的旧数据)

Redis进阶学习笔记 目录: 一、Redis 的基础知识 1.1、什么是 Redis 1.2、为什么要有 Redis 二、内存管理与淘汰机制 2.1、内存过期策略 2.2、内存淘汰机制 三、持久化 3.1、RDB 持久化 3.2、AOF 持久化 3.3、RDB-AOF 混合持久化(Redis 4.0) 四、Redis集群方案 4.1、单机模式(Standalone) 4.2、主从复制(Replication) 4.3、哨兵模式(Redis Sentinel) 4.4、Redis Cluster 五、应用场景 5.1 数据库 5.2 系统缓存 5.3 消息队列 5.4 计数器和排行榜 5.5 分布式锁 六、缓存相关问题 6.1、缓存穿透 6.2、缓存击穿 6.3、缓存雪崩 Redis 官网:Redis - The Real-time Data Platform 一、Redis 的基础知识 1.1、什么是 Redis Redis(REmote DIctionary Server)是一个开源的、基于内存的、键值对(Key-Value)数据库,它支持多种数据结构,并提供原子操作、事务、Lua脚本、发布订阅等高级特性。 Redis 支持的基础数据类型有五种: 数据类型 介绍 底层实现 特点 String(字符串) 最基础、最常用的数据类型 SDS(简单动态字符串) 可以存储:字符串、整数、浮点数、二进制数据单个数据最大支持 512MB支持原子操作(如自增、自减) List(列表) 本质是一个双向链表 压缩列表 / 双向链表 有序、可重复支持从两端插入/弹出操作时间复杂度:头尾 O(1) Hash(哈希) 类似于 Map<String, String> 压缩列表 / 哈希表 存储键值对集合(field-value)适合存储对象支持单字段读写 Set(集合) 无序、不 哈希表 / 整数集合 自动去重支持集合运算(交集、并集、差集) ZSet(Sorted Set,有序集合) 在 Set 基础上增加了一个 score(分数) 用来排序 跳跃表 + 哈希表 元素唯一,但 score 可重复按 score 自动排序(底层是跳跃表 + 哈希表)查询效率高(范围查询) 还有几种基于基础数据类型的扩展类型: 数据类型 介绍 特点 Bitmap(位图) 基于 String 的按位操作 每一位是 0 或 1非常节省空间(适合大规模布尔状态) HyperLogLog 用于基数统计(去重计数)的概率算法 占用极小内存(≈12KB)有一定误差(约 0.81%) Geospatial(地理位置) 用于存储地理位置信息 基于 Sorted Set 实现支持距离计算、范围搜索 Stream(流,Redis 5+) 类似消息队列,但功能更强 支持消费组(Consumer Group)支持消息持久化可回溯消息 1.2、为什么要有 Redis 传统关系型数据库(如 MySQL)擅长复杂查询和事务,但磁盘 I/O 导致高并发下存在延迟高、吞吐低的问题,因此数据库的读写性能往往会成为瓶颈。 而加入 Redis 作为高性能缓存,将使用频率高的数据(热点数据)放在内存中,需要时可以直接通过请求 Redis 获取,只有当 Redis 获取不到时才会查询数据库,这种方式可以降低数据库的压力,同时还显著提升系统的响应速度和吞吐量。 Redis 的主要优势包括: 基于内存:所有数据存储在内存中,读写也基于内存操作,避免了磁盘 I/O,因此速度极快,这是最根本的原因; 单线程模型(核心I/O线程): 准确来讲,Redis 不是完全单线程,Redis 6.0 之后,网络I/O、持久化会使用多线程,但命令执行依然是单线程; 在进行读写操作时,单线程可以避免多线程的上下文切换和竞争(锁竞争、死锁)带来的额外开销,反而提升了处理速度,此时的瓶颈不在CPU,而在内存和网络; 并且由于单线程没有了复杂的同步机制,因此也不易出错; I/O多路复用机制:让单线程能同时监听多个 socket 连接,当某个连接有数据请求时,才去处理。类似于一个服务员同时服务很多桌客人,谁举手就去谁那。使用了epoll等高效机制; 高效的数据结构:底层针对不同场景设计了极致优化的数据结构。 二、内存管理与淘汰机制 Redis 是内存数据库,随着应用的运行,如果不清理,Redis 中的 Key 会不断增加,最终内存耗尽导致 OOM(Out Of Memery)。 针对于内存溢出问题,Redis 通过内存过期策略预防内存溢出,而当内存使用达到 maxmemory 上限导致新 Key 无法写入时,Redis 使用内存淘汰机制淘汰旧数据为新数据腾出空间。 2.1、内存过期策略 Redis 通过为 Key 设置过期时间(TTL)来管理内存中的数据生命周期。当 Key 的过期时间到达时,Redis 会自动删除该键及其对应的值,以避免旧数据的无限累计。 内存过期策略主要包括: 定时删除:为每个设置过期时间的 Key 维护一个定时器,当过期时间到达时立即删除。但这种方式会消耗大量的CPU资源,比较影响性能。 惰性删除:在访问 Key 时才检查其是否过期,如果过期则删除。这种方式不会额外消耗CPU资源,但可能导致内存中存在大量过期的 Key,占用内存空间。 需要说明的是,Redis 并不是在 Key 到期的一瞬间就立刻将其从内存中删除,而是采用了定时删除与惰性删除两种策略的组合: Redis 内部开了一个定时任务,默认每段时间(比如 100ms)运行一次; 从设置了过期时间(TTL)的 Key 中随机抽取 20 个数据进行检查; 如果这 20 个 Key 中过期的 Key 占比超过 25%(即超过 5 个),Redis 会认为当前内存中过期 Key 较多,不会等待下一个 100ms,而是立即重复上一个步骤继续抽查、继续清理,直到过期的 Key 占比低于 25%。 内存过期策略也有可能会导致一个问题,如果同一时刻大量数据过期或者 Redis 无法提供服务,客户端请求从 Redis 中获取不到已过期的数据就会查询数据库,从而使数据库请求激增,压力过大造成数据库服务器宕机,即缓存雪崩。 所以要避免大量数据在同一时刻过期,解决办法是在固定过期时间上增加一个随机偏移量,同时对于热点数据,不设置过期时间,使其达到“物理”上的永不过期,可以避免缓存击穿问题。 2.2、内存淘汰机制 当内存使用达到 maxmemory 上限,且新数据写入时,触发淘汰策略,根据配置的内存淘汰策略删除部分键值对以释放内存。 那么应该选择哪些数据淘汰,大致的思想有两种: LRU(Least Recently Used)是按照最近最少使用原则来筛选数据,即最不常用的数据会被筛选出来; LFU(Least Frequently Used)是 Redis4 新增的淘汰策略,它根据 key 的最近访问频率进行淘汰,即访问次数最少的数据会被筛选出来。 再结合淘汰数据的范围(全部 Key 或设置了过期时间的 Key),那么综合考虑下来内存淘汰策略就有八种: 策略 描述 适用场景 noeviction 默认策略。不淘汰,写请求直接返回错误(如SET失败) 数据绝不能丢的场景,如作为数据库 allkeys-random 从所有key中随机淘汰 缓存数据访问频率相近 allkeys-lru 从所有数据中淘汰最近最少使用(LRU)的key 通用缓存,希望保留最可能被再次访问的数据 allkeys-lfu(Redis4.0) 从所有数据中淘汰使用频率最低(LFU)的key 通用缓存,希望保留经常被访问的数据 volatile-ttl 从设置了过期时间的key中,淘汰将要过期的key 通用缓存,希望优先淘汰快过期的数据 volatile-random 从设置了过期时间的key中,随机淘汰key 缓存数据访问频率相近 volatile-lru 从设置了过期时间的数据中淘汰最近最少使用(LRU)的key 通用缓存,希望保留最可能被再次访问的数据 volatile-lfu(Redis4.0) 从设置了过期时间的数据中淘汰使用频率最低(LFU)的key 通用缓存,希望保留经常被访问的数据,比LRU更精准 结合内存过期策略来说,如果此时设置的淘汰策略是 allkeys-lru 或 allkeys-random,那么即使某个 Key 还没到过期时间,也可能被提前淘汰,使用 volatile-lru 或 volatile-ttl 策略,即只针对有过期时间的 Key 进行淘汰,就可以解决这个问题。 三、持久化 对于 Redis 来说,由于数据都在内存中,如果发生断电或进程崩溃时就必然面临数据丢失的风险,因此有了数据的持久化,以便在 Redis 重启后能恢复数据。 Redis 支持的持久化方式有三种:RDB 持久化、AOF 持久化和 RDB-AOF 混合持久化。 3.1、RDB 持久化 RDB(Redis Database)是 Redis 默认采用的持久化方式,它的原理是 Redis 在后台 fork(复制)一个子进程,子进程将该时间的内存数据生成快照文件写入到磁盘中,创建一个经过压缩的 “.rdb” 二进制文件,存储各个数据库的键值对数据等信息。 RDB 持久化的触发方式有两种: 手动触发:通过 SAVE 或 BGSAVE 命令触发 RDB 持久化操作,创建“.rdb”文件; 自动触发:通过配置选项,让服务器在满足指定条件时自动执行 BGSAVE 命令。 RDB 持久化的优缺点: 优点:RDB生成紧凑压缩的二进制文件,体积小,恢复数据的速度非常快; 缺点:RDB 持久化没办法做到实时,BGSAVE 每次运行都要执行 fork 操作创建子进程,属于重量级操作,不宜频繁执行。 3.2、AOF 持久化 AOF 持久化的原理是记录了每次写入命令到 “.aof” 格式的文本文件,类似MySQL的binlog,当 Redis 重启时再重新执行 AOF 文件中的命令来恢复数据到内存中。 AOF的工作流程包括:命令写入(append)、文件同步(sync)、文件重写(rewrite)、重启加载(load)。 需要控制命令同步到硬盘的频率,即多久将命令写入到 AOF 文件中一次,就是同步策略 (appendfsync): appendfsync always:每次写操作后立即同步到磁盘。最安全,但性能最差; appendfsync everysec:每秒同步一次。折中方案,默认推荐,最多丢1秒数据,性能和安全平衡最好; appendfsync no:由操作系统决定同步时机。最快,但最不安全,但可能丢大量数据。 AOF 重写(Rewrite)机制:为了解决文件越来越大的问题,Redis会自动(或手动 BGREWRITEAOF)在后台重写 AOF 文件。只保留“当前数据集的最小命令集合”,去掉冗余操作(比如多次 SET 同一个 Key,只留最后一次)。重写操作由子进程完成,不会阻塞主进程。 AOF 持久化的优缺点: 优点: 数据安全性高,最多丢失一秒的数据; 生成的 “.aof” 格式的日志文件可读,便于调试和修复。 缺点: 文件通常比RDB大,恢复数据慢(因为需要逐条重新执行命令); 对性能有一定影响(尤其是 always 策略)。 3.3、RDB-AOF 混合持久化(Redis 4.0) RDB 持久化和 AOF 持久化都有各自鲜明的优缺点,因此从 Redis4.0 开始引入集成二者优点的持久化方式:RDB-AOF 混合持久化,这种方式的原理是将内存数据先以 RDB 格式写入一个快照到 AOF 文件头部,后续再把写命令追加到快照后面,恢复时先恢复数据的快照,再执行后面的追加命令。 与 AOF 持久化类似,RDB-AOF 混合持久化也具备同步策略和重写机制。 优势:兼顾了 RDB 持久化的加载速度和 AOF 持久化的数据安全,是 Redis 生产环境的首选方案。 四、Redis集群方案 4.1、单机模式(Standalone) 一台服务器上运行一个Redis实例(redis-server)。数据全部放在一台机器的内存里,所有读写操作都经过这个实例,没有任何备份或扩展。 优点:部署简单,适合开发、测试、小型项目;且性能最好,因为没有网络复制开销 缺点:机器宕机、Redis进程崩溃,都会导致服务完全不可用;数据量超过单机内存或 QPS 过高,就扛不住。 4.2、主从复制(Replication) 一个主节点(Master)负责处理写请求,多个从节点(Replica / Slave)实时复制主节点(Master)的数据,只负责处理读请求。整个集群的数据流向是单向的:Master -> Slave。 优点:结构简单,配置容易;从节点分担主节点读压力,极大提升 QPS 缺点:所有写操作都依赖主节点,写性能上限受限于主节点,无法水平扩展写能力;主节点故障需要人工干预切换,无法自动故障转移;异步复制可能导致轻微数据不一致 4.3、哨兵模式(Redis Sentinel) 哨兵模式基于主从模式扩展,主要解决主从模式中主节点(Master)宕机无法自动恢复的问题,以实现高可用。 在主从架构的基础上,引入一组独立的 Sentinel(哨兵)节点。Sentinel 不处理业务读写,只负责心跳检测主从节点,当主节点故障(客观下线),哨兵通过 Raft 协议投票选出一个新的主节点,并通知客户端和其他从节点。 主观下线与客观下线:一个 Sentinel 认为节点挂了是主观下线,半数以上 Sentinel 认为挂了才是客观下线,避免网络误判。 哨兵节点的数量至少为 3 个,且为奇数个,以避免脑裂问题,总体架构推荐至少 3 Sentinel + 1 Master + 2+ Replica。 优点:保留了主从模式的优点,依然支持读写分离,从节点分担读压力;实现了故障自动检测和切换 缺点:本质上还是主从模式,写性能上限受限于主节点,依然无法水平扩展写能力;且主从切换过程中,Redis 会短暂不可用 4.4、Redis Cluster Redis Cluster 是 Redis 官方提供的分布式解决方案,自 Redis 3.0 引入,旨在通过分片(Sharding)技术将数据分布在多个主节点上,解决单机写瓶颈和内存容量瓶颈。 Redis Cluster 将整个数据集分成 16384 个哈希槽(Hash Slot)。每个键通过 CRC16(key) % 16384 计算后,决定落在哪个槽位。集群中存在多个主节点(Master),每个主节点负责一段连续的槽位区间(如 0-5000、5001-10000、10001-16383),并且可挂载一个或多个从节点(Replica)作为数据备份实现高可用。节点之间通过 Gossip 协议相互通信,自动发现新节点、传播故障信息、协调槽位迁移。客户端连接任意一个节点,若请求的数据不在当前节点,节点会返回正确的目标节点地址(MOVED 重定向),智能客户端根据新的目标节点地址自动跳转到正确的节点。 优点: 数据容量水平扩展:总数据量不再受限于单机内存,集群总容量随节点增加而线性增长 写性能水平扩展:写操作分散到多个主节点,增加节点即可线性提升写吞吐量,彻底突破单机写瓶颈 内置高可用:主节点故障自动转移,无需人工干预,比哨兵 Sentinel 更快 故障隔离更好:单个节点故障只影响部分数据,只影响它负责的槽位,其他数据仍可正常读写 缺点: 复杂度高:搭建、监控、运维更麻烦(需要处理 slot 迁移、热点 slot 等) 客户端要求高:必须用支持Cluster的客户端(Redisson、go-redis等),否则需要处理MOVED重定向 批量操作受限:不支持跨节点的事务、和多 Key 操作(除非 Key 带有相同的 {hashtag},强制将其分配到同一槽位) 资源消耗更高:至少6个节点起步 数据倾斜风险:热点key可能集中在某个节点,需要优化key设计 五、应用场景 5.1 数据库 Redis 可以作为主数据库使用,适用于对性能要求高、数据量相对较小的场景,如会话存储、实时排行榜等。 5.2 系统缓存 Redis 最常见的用途是作为缓存层,通过缓存热点数据,可以减少对数据库的查询次数,减轻数据库负担,显著提高应用访问速度。 5.3 消息队列 Redis 的列表和发布/订阅模式可以用于实现消息队列: 通过列表(List)的 LPUSH 和 RPOP 命令可以实现简单的消息队列功能 通过发布/订阅模式可以实现更复杂的消息分发和订阅功能 5.4 计数器和排行榜 Redis 的原子操作和有序集合(ZSet)非常适合实现计数器和排行榜功能,通过为每个元素关联一个分数,可以方便地实现排序和统计功能,如网站访问统计、游戏积分榜等。 5.5 分布式锁 Redis 的原子性操作可以用于实现分布式锁。通过 SETNX 命令可以尝试获取锁,如果获取成功则执行临界区代码;执行完毕后通过 DEL 命令释放锁,保证在分布式环境下的互斥访问。为了避免死锁,还可以为锁设置过期时间。 六、缓存相关问题 在高并发系统中,使用 Redis 做缓存时,最容易引发系统故障的三大“杀手”就是缓存穿透、缓存击穿和缓存雪崩。 6.1、缓存穿透 客户端请求的数据在 Redis 中不存在(缓存未命中),同时在数据库中也不存在。每次请求都会直接打到数据库。如果是恶意构造的大量无效请求(比如 userId = -1、随机长字符串、已删除的商品 ID),数据库瞬间就被打崩。 核心特点: 查询的是“根本不存在”的数据。 缓存和数据库都无法命中,请求每次都穿透。 极易被恶意攻击利用(也叫恶意穿透)。 常见场景: 接口未做参数校验,攻击者用不存在的 ID 疯狂刷接口。 查询已下架或从未存在过的商品 / 用户详情。 解决方式: 接口层参数校验(第一道防线):对请求参数做基础合法性检查(格式、长度等),提前过滤无效请求 缓存空对象(空值缓存)(最常用、简单有效):当数据库返回 null/空时,也在 Redis 中缓存一个空结果,并设置较短的过期时间(建议 30 秒 ~ 5 分钟,避免长期占用内存) 布隆过滤器(Bloom Filter):在 Redis 前加一层布隆过滤器,提前判断该 Key 是否可能存在,如果肯定不存在,直接返回 null,不查 Redis 和数据库,如果可能存在,再走正常缓存流程。 6.2、缓存击穿 某个高并发热点 Key 的缓存突然过期(或被删除),而此时有大量并发请求同时到达。所有请求发现缓存 miss,同时去查数据库,导致数据库瞬时压力暴增,甚至宕机。 核心特点: 问题发生在单个热点 Key 过期瞬间。 查询的是真实存在且非常热门的数据。 影响虽然是单个 Key,但并发量极大,破坏力强。 常见场景: 秒杀商品的库存/详情 Key 刚好过期。 热门新闻、明星话题、爆款商品的缓存到期。 大促期间某个热卖品的缓存失效。 解决方式(核心:只让一个请求去查数据库,其他等待或用旧数据): 缓存未命中时,先尝试获取分布式锁。只有拿到锁的线程才允许查询数据库,其他线程等待或短暂重试。 不依赖 Redis 的原生 expire,而是把“过期时间”字段存到 Value 里(例如 JSON 中加一个 expireTime)。用户请求时,如果发现逻辑已过期,后台异步线程去刷新数据,用户先返回旧数据 热点数据永不过期 + 后台刷新 对极重要热点 Key 不设过期时间,或设很长 TTL,由定时任务/消息队列后台定期刷新 6.3、缓存雪崩 大量缓存 Key 在同一时间段内集体过期(或 Redis 实例宕机),导致海量请求同时穿透到数据库,数据库压力骤增,甚至引发连锁反应导致系统雪崩。 核心特点: 影响的是大量 Key(而非单个)。 通常发生在同一时刻大量 Key 同时失效。 后果最严重,可能导致整个服务不可用。 常见场景: 所有 Key 统一设置相同过期时间(如全设 30 分钟)。 大促活动结束,大量活动缓存同时到期。 Redis 重启或故障(无持久化时,所有缓存瞬间丢失)。 解决方式: 最简单、最有效:设置过期时间时加上随机偏移,避免大量 Key 同时到期 缓存预热 + 永不过期策略:提前把热点数据加载到缓存;核心数据可永不过期,由后台异步更新 多级缓存:第一层用 Caffeine/Guava 本地缓存挡住大部分请求,Redis 作为二级,数据库作为最后防线 熔断降级 + 限流 + 快速失败:使用 Sentinel / Hystrix / Resilience4j 等框架:当数据库压力过大时,快速熔断,返回兜底数据(“系统繁忙,请稍后重试”或缓存的旧数据) -

Docker学习笔记 目录: 一、Docker 1.1、什么是 Docker 1.2、安装 Docker 1.3、更改镜像源 二、基本概念 2.1、镜像(Image) 2.2、容器(Container) 2.3、标签(Tag) 2.4、仓库(Repository)与注册中心(Registry) 二、命令 2.1、镜像管理 从 Dockerfile 构建镜像: 从远程仓库拉取某个镜像: 将本地镜像推送到远程仓库 列出本地所有镜像 列出与关键词匹配的本地镜像 查看镜像的详细信息(以 JSON 格式输出) 查看镜像的分层历史(各层的创建指令和大小) 删除本地镜像文件 删除所有悬空镜像 删除所有未被任何容器使用的镜像 将镜像保存为 tar 文件(一般用于离线迁移) 从 tar 文件加载镜像到本地 给镜像打标签: 2.2、容器启停 创建并启动容器 只创建容器,不启动 启动已经创建的容器: 在运行的容器中执行命令 停止运行中的容器: 强制停止容器: 重启容器: 2.3、容器管理 查看运行中的容器 删除已停止的容器 删除所有已停止容器 查看容器的标准输出和错误日志: 查看容器内运行的进程 试试监控容器的 CPU、内存、网络等资源使用情况 在主机与容器之间复制文件 导出容器为 tar 文件: 从 tar 文件导入为镜像: 2.4、标签管理 环境:ubuntu 24.04 一、Docker 1.1、什么是 Docker Docker是一个开源平台,用于将应用程序及其所有依赖项打包成标准的容器,从而实现“一次构建,到处运行”。 Docker 与传统虚拟机(Virtual Machine,VM)都是实现环境隔离和应用封装的技术,但它们在架构、性能、资源利用和使用场景上有本质区别。 Docker 容器除了运行其中的应用外,基本不消耗额外的系统资源,保证应用性能的同时,尽量减少系统开销。 传统虚拟机方式运行 N 个不同的应用就要起 N 个不同的虚拟机(每个虚拟机都要单独分配独占的内存、磁盘等资源),而 Docker 只需要启动 N 个隔离的“很薄的”容器,并将应用放进容器内即可。应用获得的是接近原生的运行性能。 对比维度 Docker(容器) 虚拟机(VM) 操作系统 共享宿主机内核 每个 VM 一个完整 OS 启动速度 秒级(0.1~2s) 分钟级 镜像大小 MB ~ 几百 MB GB 级 资源开销 极低 高 性能 接近裸机 有一定损耗 隔离性 进程级隔离 硬件级隔离 安全性 较弱(共享内核) 更强 可移植性 非常强 一般 运维成本 低 高 密度 单机可跑数百容器 单机只能跑少量 VM 虚拟机 = 在硬件上虚拟出一整台“电脑”,解决的是“硬件虚拟化”问题 Docker = 在操作系统上隔离出一个“进程运行环境”,解决的是“应用交付与环境一致性”问题 可以粗略类比为: 虚拟机:每个租户 独立一套房子(含水电) Docker:每个租户 独立一个房间,共用整栋楼的水电 Docker 官网:Docker: Accelerated Container Application Development Docker 官方文档:Manuals | Docker Docs 国内中文翻译文档:Docker中文文档(Docker官方文档,Docker官方教程) 1.2、安装 Docker 使用官方安装脚本: # 下载并执行Docker官方安装脚本 curl -fsSL https://get.docker.com -o get-docker.sh sudo sh get-docker.sh 或者通过添加 Docker 软件源安装: sudo apt-get update sudo apt-get install ca-certificates curl -y sudo install -m 0755 -d /etc/apt/keyrings sudo curl -fsSL https://mirrors.cloud.tencent.com/docker-ce/linux/ubuntu/gpg -o /etc/apt/keyrings/docker.asc sudo chmod a+r /etc/apt/keyrings/docker.asc echo "deb [arch=$(dpkg --print-architecture) signed-by=/etc/apt/keyrings/docker.asc] https://mirrors.cloud.tencent.com/docker-ce/linux/ubuntu/ \ $(. /etc/os-release && echo "$VERSION_CODENAME") stable" | sudo tee /etc/apt/sources.list.d/docker.list > /dev/null sudo apt-get update sudo apt-get install docker-ce docker-ce-cli containerd.io docker-buildx-plugin docker-compose-plugin 用上面任何一种方法安装完成 Docker 之后启动: # 启动Docker服务 sudo systemctl start docker # 设置开机自启 sudo systemctl enable docker 执行以下命令,检查安装结果: sudo docker info 输出版本信息则说明安装成功。 1.3、更改镜像源 需要说明的是,以往在国内使用很普遍的腾讯云、阿里云和各个大学的 Docker 镜像站点自从 2024 年之后都陆续不可用,现在可使用的镜像源已经很少,也不确定能用多久, 开发者镜像 - 免费手机工具 站长工具 源代码查看器 Docker镜像极速下载服务 - 毫秒镜像 Docker 镜像免费公共测试访问入口 | 轩辕镜像免费版 而在国内买了云服务商的服务器的话,可以使用其提供的内网 Docker 镜像,不过只能在其服务器上使用而无法在外网机器上使用。 腾讯云:腾讯云 - 安装 Docker 并配置镜像加速源,阿里云:阿里云 - 容器镜像服务,文档中明确写 https://mirror.ccs.tencentyun.com 只支持内网访问,不再支持外网域名访问加速。 找到配置镜像源的文件(如果文件不存在请新建) /etc/docker/daemon.json ,写入如下内容: { "registry-mirrors" : [ "https://docker.m.daocloud.io", "https://docker.xuanyuan.me", "https://docker.1ms.run" ] } 之后重新启动服务: sudo systemctl daemon-reload sudo systemctl restart docker 执行 docker info 命令检查配置是否成功,如果输出内容中 Registry Mirrors 一项变成了配置的镜像源,则说明更改镜像源成功。 二、基本概念 2.1、镜像(Image) 镜像是一个用于创建容器(Container)只读模板,可以粗略理解为面向对象编程中的“类”(Class),其包含了运行一个软件所需的代码、运行环境、库、环境变量和配置文件等。 镜像具有如下特点: 不可变:镜像一旦构建完成,内容便默认不可修改 分层结构:镜像采用联合文件系统(UnionFS),以分层方式组织文件,使得多个镜像可以共享相同的基础层,从而节省空间 可分发:镜像可以被推送到远程注册中心(如 Docker Hub)或从注册中心拉取,实现跨平台使用 2.2、容器(Container) 容器时镜像的运行实例,类似于“对象”,是镜像这个“类”的一个具体实例。当启动一个镜像时,Docker 会基于该镜像创建一个容器,并在其中运行应用程序(例如Nginx、MySQL等)。 容器的特点: 可读写:虽然镜像不可修改,但容器在镜像的基础上增加了一个可写层,所有对系统的修改都发生在这个层中。 具有生命周期:可以启动、停止、暂停、删除。 资源隔离:容器之间默认隔离无法交互的,通过 Linux 的 Namespace 和 Cgroups 技术实现进程、网络、文件系统的资源的隔离与限制。 2.3、标签(Tag) 标签用于标识镜像的特定版本或变体。一个镜像可以有多个标签,但它们可能指向同一个镜像 ID(即内容相同)。 如果不指定标签,默认使用 latest 注意:latest 并不一定代表“最新稳定版”,它只是一个约定俗成的标签,实际含义由镜像维护者决定。 2.4、仓库(Repository)与注册中心(Registry) 仓库(Repository):存储同一软件不同标签(版本)镜像的集合。例如 library/nginx 是 Docker Hub 上 nginx 的官方仓库。 注册中心(Registry):存放多个仓库的服务。最常见的是 Docker Hub,也可以搭建私有 Registry(如 Harbor、GitLab Container Registry)。 示例完整镜像名: docker.io/library/nginx:1.25 其中: docker.io:Registry 地址(默认可省略) library:命名空间(官方镜像通常省略为 nginx) nginx:仓库名 1.25:标签 二、命令 2.1、镜像管理 Dockerhub 地址:Docker Hub Container Image Library | App Containerization 国内镜像: 从 Dockerfile 构建镜像: 参数: -t 指定镜像标签 --file 指定 Dockerfile 路径,不存在此参数时默认从当前路径下构建 docker build -t <tag> ./ 从远程仓库拉取某个镜像: 镜像标签 <tag> 可省略,默认使用 latest docker pull <image><:tag> 如果没有配置镜像源只是想要临时通过某个(docker.xuanyuan.me)镜像源拉去镜像: docker pull docker.xuanyuan.me/<image><:tag> 将本地镜像推送到远程仓库 docker push <image> 列出本地所有镜像 参数: -a 查看所有镜像 -q 只显示镜像 ID docker image list # 等价于: docker image ls # 等价于: docker images 列出与关键词匹配的本地镜像 docker image list <关键词> # 等价于: docker image ls <关键词> # 等价于: docker images <关键词> 查看镜像的详细信息(以 JSON 格式输出) docker image inspect <image> 查看镜像的分层历史(各层的创建指令和大小) docker image history <image> 删除本地镜像文件 参数: -f 强制删除 -a 删除所有未使用镜像 <image> 可以是文件名,也可以是镜像 ID docker image rm <image> # 简写: docker rmi <image> 注意:当存在依赖于该镜像创建的容器时,镜像文件默认是无法被删除的。尽管可以使用 -f 参数来强制删除一个存在容器依赖的镜像,但并不推荐。正确的做法是,先删除依赖该镜像的所有容器之后再删除镜像。 删除所有悬空镜像 悬空镜像:Dangling Images,即没有标签且未被容器引用的镜像,通常出现在重新构建同名镜像后,旧镜像失去标签但仍存在) docker image prune 删除所有未被任何容器使用的镜像 docker image prune -a 将镜像保存为 tar 文件(一般用于离线迁移) docker save -o <file.tar> <image> 从 tar 文件加载镜像到本地 docker load -i <file.tar> 给镜像打标签: docker tag <image> <tag>qq 2.2、容器启停 Docker 运行容器前需要本地存在对应的镜像(Image), 如果本地不存在该镜像,Docker 会尝试从配置文件(/etc/docker/daemon.json)的注册中心中下载。 创建并启动容器 参数: -d 后台运行 -it 交互式终端 --name 指定容器名 -p host:container,端口映射 -v /host:/container,卷挂载 --restart 重启策略 docker run [OPTIONS] <image> 例如: docker run -d --name nginx-app-test -p 8080:80 nginx 只创建容器,不启动 参数: --name 容器名 -v 卷挂载 docker create -i <container> --name <name> 启动已经创建的容器: 参数:-i 交互式启动 docker start -i <container> 在运行的容器中执行命令 参数: -it 交互式终端 docker exec -it <container> <command> 停止运行中的容器: 优雅停止容器,会向容器发送 SIGTERM,等待退出 参数:-t 停止等待时间(单位为秒) docker stop -t <time> 强制停止容器: 会向容器发送 SIGKILL。同Linux的kill -9 docker kill <container> 重启容器: 参数:-t 停止等待时间(单位为秒) docker restart <container> 2.3、容器管理 查看运行中的容器 参数: -a 查看所有容器 -q 只显示容器ID docker ps # 等价于: docker container ls 删除已停止的容器 docker rm <container> 若要删除的容器仍在运行,需加上参数 -f: docker rm -f <container> 删除所有已停止容器 docker container prune 查看容器的标准输出和错误日志: 参数: -f 跟踪日志 --tail <n> 显示最后 n 行 docker logs <container> 查看容器内运行的进程 docker top <container> 试试监控容器的 CPU、内存、网络等资源使用情况 docker stats <container> 在主机与容器之间复制文件 docker cp ... 从主机复制文件到容器: docker cp <主机路径> <容器名或ID>:<容器内路径> # 例如: docker cp ./app.conf myapp:/etc/app.conf 从容器复制文件到主机: docker cp <容器名或ID>:<容器内路径> <主机路径> # 例如: docker cp myapp:/var/log/app.log ./ 导出容器为 tar 文件: 参数:-o 指定输出文件名 docker export <container> -o <file.tar> 从 tar 文件导入为镜像: docker import <file.tar> 2.4、标签管理 给镜像打标签: docker tag <image> <tag> 删除特定标签: docker rmi <image>:<tag> 参考文档: Docker - 马燕龙个人博客 云服务器 搭建 Docker_腾讯云 Docker 教程 | 菜鸟教程

Docker学习笔记 目录: 一、Docker 1.1、什么是 Docker 1.2、安装 Docker 1.3、更改镜像源 二、基本概念 2.1、镜像(Image) 2.2、容器(Container) 2.3、标签(Tag) 2.4、仓库(Repository)与注册中心(Registry) 二、命令 2.1、镜像管理 从 Dockerfile 构建镜像: 从远程仓库拉取某个镜像: 将本地镜像推送到远程仓库 列出本地所有镜像 列出与关键词匹配的本地镜像 查看镜像的详细信息(以 JSON 格式输出) 查看镜像的分层历史(各层的创建指令和大小) 删除本地镜像文件 删除所有悬空镜像 删除所有未被任何容器使用的镜像 将镜像保存为 tar 文件(一般用于离线迁移) 从 tar 文件加载镜像到本地 给镜像打标签: 2.2、容器启停 创建并启动容器 只创建容器,不启动 启动已经创建的容器: 在运行的容器中执行命令 停止运行中的容器: 强制停止容器: 重启容器: 2.3、容器管理 查看运行中的容器 删除已停止的容器 删除所有已停止容器 查看容器的标准输出和错误日志: 查看容器内运行的进程 试试监控容器的 CPU、内存、网络等资源使用情况 在主机与容器之间复制文件 导出容器为 tar 文件: 从 tar 文件导入为镜像: 2.4、标签管理 环境:ubuntu 24.04 一、Docker 1.1、什么是 Docker Docker是一个开源平台,用于将应用程序及其所有依赖项打包成标准的容器,从而实现“一次构建,到处运行”。 Docker 与传统虚拟机(Virtual Machine,VM)都是实现环境隔离和应用封装的技术,但它们在架构、性能、资源利用和使用场景上有本质区别。 Docker 容器除了运行其中的应用外,基本不消耗额外的系统资源,保证应用性能的同时,尽量减少系统开销。 传统虚拟机方式运行 N 个不同的应用就要起 N 个不同的虚拟机(每个虚拟机都要单独分配独占的内存、磁盘等资源),而 Docker 只需要启动 N 个隔离的“很薄的”容器,并将应用放进容器内即可。应用获得的是接近原生的运行性能。 对比维度 Docker(容器) 虚拟机(VM) 操作系统 共享宿主机内核 每个 VM 一个完整 OS 启动速度 秒级(0.1~2s) 分钟级 镜像大小 MB ~ 几百 MB GB 级 资源开销 极低 高 性能 接近裸机 有一定损耗 隔离性 进程级隔离 硬件级隔离 安全性 较弱(共享内核) 更强 可移植性 非常强 一般 运维成本 低 高 密度 单机可跑数百容器 单机只能跑少量 VM 虚拟机 = 在硬件上虚拟出一整台“电脑”,解决的是“硬件虚拟化”问题 Docker = 在操作系统上隔离出一个“进程运行环境”,解决的是“应用交付与环境一致性”问题 可以粗略类比为: 虚拟机:每个租户 独立一套房子(含水电) Docker:每个租户 独立一个房间,共用整栋楼的水电 Docker 官网:Docker: Accelerated Container Application Development Docker 官方文档:Manuals | Docker Docs 国内中文翻译文档:Docker中文文档(Docker官方文档,Docker官方教程) 1.2、安装 Docker 使用官方安装脚本: # 下载并执行Docker官方安装脚本 curl -fsSL https://get.docker.com -o get-docker.sh sudo sh get-docker.sh 或者通过添加 Docker 软件源安装: sudo apt-get update sudo apt-get install ca-certificates curl -y sudo install -m 0755 -d /etc/apt/keyrings sudo curl -fsSL https://mirrors.cloud.tencent.com/docker-ce/linux/ubuntu/gpg -o /etc/apt/keyrings/docker.asc sudo chmod a+r /etc/apt/keyrings/docker.asc echo "deb [arch=$(dpkg --print-architecture) signed-by=/etc/apt/keyrings/docker.asc] https://mirrors.cloud.tencent.com/docker-ce/linux/ubuntu/ \ $(. /etc/os-release && echo "$VERSION_CODENAME") stable" | sudo tee /etc/apt/sources.list.d/docker.list > /dev/null sudo apt-get update sudo apt-get install docker-ce docker-ce-cli containerd.io docker-buildx-plugin docker-compose-plugin 用上面任何一种方法安装完成 Docker 之后启动: # 启动Docker服务 sudo systemctl start docker # 设置开机自启 sudo systemctl enable docker 执行以下命令,检查安装结果: sudo docker info 输出版本信息则说明安装成功。 1.3、更改镜像源 需要说明的是,以往在国内使用很普遍的腾讯云、阿里云和各个大学的 Docker 镜像站点自从 2024 年之后都陆续不可用,现在可使用的镜像源已经很少,也不确定能用多久, 开发者镜像 - 免费手机工具 站长工具 源代码查看器 Docker镜像极速下载服务 - 毫秒镜像 Docker 镜像免费公共测试访问入口 | 轩辕镜像免费版 而在国内买了云服务商的服务器的话,可以使用其提供的内网 Docker 镜像,不过只能在其服务器上使用而无法在外网机器上使用。 腾讯云:腾讯云 - 安装 Docker 并配置镜像加速源,阿里云:阿里云 - 容器镜像服务,文档中明确写 https://mirror.ccs.tencentyun.com 只支持内网访问,不再支持外网域名访问加速。 找到配置镜像源的文件(如果文件不存在请新建) /etc/docker/daemon.json ,写入如下内容: { "registry-mirrors" : [ "https://docker.m.daocloud.io", "https://docker.xuanyuan.me", "https://docker.1ms.run" ] } 之后重新启动服务: sudo systemctl daemon-reload sudo systemctl restart docker 执行 docker info 命令检查配置是否成功,如果输出内容中 Registry Mirrors 一项变成了配置的镜像源,则说明更改镜像源成功。 二、基本概念 2.1、镜像(Image) 镜像是一个用于创建容器(Container)只读模板,可以粗略理解为面向对象编程中的“类”(Class),其包含了运行一个软件所需的代码、运行环境、库、环境变量和配置文件等。 镜像具有如下特点: 不可变:镜像一旦构建完成,内容便默认不可修改 分层结构:镜像采用联合文件系统(UnionFS),以分层方式组织文件,使得多个镜像可以共享相同的基础层,从而节省空间 可分发:镜像可以被推送到远程注册中心(如 Docker Hub)或从注册中心拉取,实现跨平台使用 2.2、容器(Container) 容器时镜像的运行实例,类似于“对象”,是镜像这个“类”的一个具体实例。当启动一个镜像时,Docker 会基于该镜像创建一个容器,并在其中运行应用程序(例如Nginx、MySQL等)。 容器的特点: 可读写:虽然镜像不可修改,但容器在镜像的基础上增加了一个可写层,所有对系统的修改都发生在这个层中。 具有生命周期:可以启动、停止、暂停、删除。 资源隔离:容器之间默认隔离无法交互的,通过 Linux 的 Namespace 和 Cgroups 技术实现进程、网络、文件系统的资源的隔离与限制。 2.3、标签(Tag) 标签用于标识镜像的特定版本或变体。一个镜像可以有多个标签,但它们可能指向同一个镜像 ID(即内容相同)。 如果不指定标签,默认使用 latest 注意:latest 并不一定代表“最新稳定版”,它只是一个约定俗成的标签,实际含义由镜像维护者决定。 2.4、仓库(Repository)与注册中心(Registry) 仓库(Repository):存储同一软件不同标签(版本)镜像的集合。例如 library/nginx 是 Docker Hub 上 nginx 的官方仓库。 注册中心(Registry):存放多个仓库的服务。最常见的是 Docker Hub,也可以搭建私有 Registry(如 Harbor、GitLab Container Registry)。 示例完整镜像名: docker.io/library/nginx:1.25 其中: docker.io:Registry 地址(默认可省略) library:命名空间(官方镜像通常省略为 nginx) nginx:仓库名 1.25:标签 二、命令 2.1、镜像管理 Dockerhub 地址:Docker Hub Container Image Library | App Containerization 国内镜像: 从 Dockerfile 构建镜像: 参数: -t 指定镜像标签 --file 指定 Dockerfile 路径,不存在此参数时默认从当前路径下构建 docker build -t <tag> ./ 从远程仓库拉取某个镜像: 镜像标签 <tag> 可省略,默认使用 latest docker pull <image><:tag> 如果没有配置镜像源只是想要临时通过某个(docker.xuanyuan.me)镜像源拉去镜像: docker pull docker.xuanyuan.me/<image><:tag> 将本地镜像推送到远程仓库 docker push <image> 列出本地所有镜像 参数: -a 查看所有镜像 -q 只显示镜像 ID docker image list # 等价于: docker image ls # 等价于: docker images 列出与关键词匹配的本地镜像 docker image list <关键词> # 等价于: docker image ls <关键词> # 等价于: docker images <关键词> 查看镜像的详细信息(以 JSON 格式输出) docker image inspect <image> 查看镜像的分层历史(各层的创建指令和大小) docker image history <image> 删除本地镜像文件 参数: -f 强制删除 -a 删除所有未使用镜像 <image> 可以是文件名,也可以是镜像 ID docker image rm <image> # 简写: docker rmi <image> 注意:当存在依赖于该镜像创建的容器时,镜像文件默认是无法被删除的。尽管可以使用 -f 参数来强制删除一个存在容器依赖的镜像,但并不推荐。正确的做法是,先删除依赖该镜像的所有容器之后再删除镜像。 删除所有悬空镜像 悬空镜像:Dangling Images,即没有标签且未被容器引用的镜像,通常出现在重新构建同名镜像后,旧镜像失去标签但仍存在) docker image prune 删除所有未被任何容器使用的镜像 docker image prune -a 将镜像保存为 tar 文件(一般用于离线迁移) docker save -o <file.tar> <image> 从 tar 文件加载镜像到本地 docker load -i <file.tar> 给镜像打标签: docker tag <image> <tag>qq 2.2、容器启停 Docker 运行容器前需要本地存在对应的镜像(Image), 如果本地不存在该镜像,Docker 会尝试从配置文件(/etc/docker/daemon.json)的注册中心中下载。 创建并启动容器 参数: -d 后台运行 -it 交互式终端 --name 指定容器名 -p host:container,端口映射 -v /host:/container,卷挂载 --restart 重启策略 docker run [OPTIONS] <image> 例如: docker run -d --name nginx-app-test -p 8080:80 nginx 只创建容器,不启动 参数: --name 容器名 -v 卷挂载 docker create -i <container> --name <name> 启动已经创建的容器: 参数:-i 交互式启动 docker start -i <container> 在运行的容器中执行命令 参数: -it 交互式终端 docker exec -it <container> <command> 停止运行中的容器: 优雅停止容器,会向容器发送 SIGTERM,等待退出 参数:-t 停止等待时间(单位为秒) docker stop -t <time> 强制停止容器: 会向容器发送 SIGKILL。同Linux的kill -9 docker kill <container> 重启容器: 参数:-t 停止等待时间(单位为秒) docker restart <container> 2.3、容器管理 查看运行中的容器 参数: -a 查看所有容器 -q 只显示容器ID docker ps # 等价于: docker container ls 删除已停止的容器 docker rm <container> 若要删除的容器仍在运行,需加上参数 -f: docker rm -f <container> 删除所有已停止容器 docker container prune 查看容器的标准输出和错误日志: 参数: -f 跟踪日志 --tail <n> 显示最后 n 行 docker logs <container> 查看容器内运行的进程 docker top <container> 试试监控容器的 CPU、内存、网络等资源使用情况 docker stats <container> 在主机与容器之间复制文件 docker cp ... 从主机复制文件到容器: docker cp <主机路径> <容器名或ID>:<容器内路径> # 例如: docker cp ./app.conf myapp:/etc/app.conf 从容器复制文件到主机: docker cp <容器名或ID>:<容器内路径> <主机路径> # 例如: docker cp myapp:/var/log/app.log ./ 导出容器为 tar 文件: 参数:-o 指定输出文件名 docker export <container> -o <file.tar> 从 tar 文件导入为镜像: docker import <file.tar> 2.4、标签管理 给镜像打标签: docker tag <image> <tag> 删除特定标签: docker rmi <image>:<tag> 参考文档: Docker - 马燕龙个人博客 云服务器 搭建 Docker_腾讯云 Docker 教程 | 菜鸟教程 -

关于华为悦盒EC6108V9的一种比较另类的救砖方法 目录: 一、前期准备 1.1、USB转TTL模块 1.2、主板上焊接针脚 二、HiTool 线刷 2.1、跑码 2.2、开始刷机 2.3、系统启动 三、破解 四、后续 五、碰到的坑 5.1、关于在刷机前配置板端ip的问题 5.2、发送数据帧失败,请检查串口连接是否正常 我手上的这个电视盒子,是2016 年家里办宽带的时候电信送的,在 2020 年疫情期间被我刷机给变砖了 :@(狂汗) 。盒子接上电源开机的时候电视完全没有反应,左边绿灯与中间红灯常亮,Recovery 进不去,使用遥控器也没有任何反应。当时还抱着卡刷救砖的希望,尝试了网上说的短接 J15 针脚强制刷机,结果一点用也没有,然后淘宝又买了 TTL 转 USB 模块准备线刷救砖,买来还没操作就被网上那些教程吓住了,再加上那段时间打游戏也打的火热,这个事也就被无限期搁置了(拖延症晚期患者 ::(酸爽) )。后来直接就买了斐讯 N1,转 N1 的阵营了,一直用到了现在。直到前两天在 B 站刷到这个将华为悦盒刷成 Ubuntu 服务器的视频: {bilibili bvid="BV1Y3411V77b" page=""/} 这个视频让我又有了天晴了雨停了我又觉得我行了的感觉,正好这几天毕业答辩的事也忙完闲下来了,所以花了一(亿)点点时间做一下最后救砖的尝试,当然最后算是成功了,所以写这篇博客来记录一下,为同样变砖的同志提供一个救砖的参考方法。 事先在此说明:这是在华为悦盒使用卡刷、强制卡刷都没有办法救砖时,并且还找不到更适配的固件的情况下,我摸索出来的一个比较另类的救砖方法,目前这个方法只在我的这个盒子上成功了,其他的盒子还没有试过(也没有条件尝试),因此并不能保证这个方法的通用性。在 ZNDS 论坛上有个类似的方式是这个(不过我并没有尝试成功)。 如果你是老司机了,那么本文救砖的方式可以试一试,救砖成功那么恭喜你,如果尝试多次还不成功的话那建议再去找找别的方式,相反如果你此前没有过刷机的经验或者经验不足,且无法独立解决报错问题,那么强烈建议慎用本文所提供的方法!! 在刷机过程中造成的损坏恕博主不能负责!!! 在刷机过程中造成的损坏恕博主不能负责!!! 在刷机过程中造成的损坏恕博主不能负责!!! 首先说明一下我手上这个盒子的型号规格:型号为华为悦盒 EC6108V9,用的 CPU 型号是 Hi3798MV100,存储规格为 1G + 4G。 型号信息: 主板布局: 一、前期准备 1.1、USB转TTL模块 线刷需要 USB 转 TTL 模块,淘宝几块钱就能买到还送杜邦线,就是这玩意: 无脑买型号是 CH340 的就行,看网上说大部分 CH340 免驱动,但是我手上这个不是,所以建议到时候跟卖家问清楚再买。甚至只要你愿意多花几块钱,还可以买到土豪金配色的(刷机时有神秘 buff 加成 :@(吐舌) )。 刷机之前检验一下 TTL 模块是否需要驱动,模块插到电脑上之后,在设备管理器 -> 端口选项下面会显示硬件名称跟端口: 如果不显示的话应该是没有驱动,打开 Win10 更新 -> 检查更新,有更新的话就点击安装就行: 1.2、主板上焊接针脚 此外还需要在电视盒子主板的 GND、RX、TX 这三个脚位上焊接三个排针,方便用杜邦线连接 TTL 模块,最后效果是这样: 需要注意的是盒子主板与 TTL 模块针脚连接的对应关系:模块的 GND 脚连接主板的 GND 脚,模块的 RX 与 TX 与主板要反着连,即模块的 RX 连接主板的 TX,TX 连接主板的 RX。 二、HiTool 线刷 线刷工具用到 HiTool,下载地址放在文末。这个软件需要 Java 环境,如果打开报错的话就配置一下 Java 环境,配置方法参考这篇博客:Win10系统配置Java开发环境 - Roookie博客 | 记录 · 收纳 · 分享 (wlplove.com)。 软件启动之后,首先要选择芯片平台,我选择了“Hi3798MV100”,然后进入软件,打开 “HiBurn”模块,这就是线刷需要用到的功能。 2.1、跑码 开始刷机前,简单介绍一下“跑码”。 这个操作在刷机失败之后查找错误原因是非常有用的。我刚开始查资料时看到网上很多人都提到了“跑码”这个词,弄得我一脸懵逼,不过跟着操作了以后就大概理解什么意思了,简单来说,跑码会在硬件启动过程中输出硬件信息、一些提示信息,也会在出现错误的时候输出错误代码,对定位硬件启动的错误有很大的帮助。 在软件菜单栏上点击这个图标打开终端窗口: 在打开的终端窗口上前三个按钮的功能分别是连接、断开连接、设置: 连接前先点击设置按钮配置一下连接端口,端口就是前面设备管理器里显示的 TTL 模块的端口: 设置完成之后,点击连接按钮,然后给盒子通电,首先会在终端输出当前设备的硬件信息,然后盒子会尝试启动系统,同时在终端输出启动过程中的提示信息,比如刚开始我的盒子就是一直循环输出同一段报错信息: 看报错信息应该是在尝试启动的过程中卡在了 fastboot 上。 2.2、开始刷机 相关文件链接已放在文末。 给盒子断电并连接网线,在软件里配置本机与盒子的 IP 地址: 串口:设备管理器里显示的 TTL 模块的连接端口 服务器 IP:本机的 IP 地址 IP 地址:网络盒子的 IP,可以不用改 网关:路由器的 IP 然后找到下方的“烧写eMMC”: 选择刷机文件目录下面的 “xml” 分区表文件,下方表格中就会自动导入相关的分区镜像,选择要刷入的分区文件,点击烧写,当下面控制台出来提示以后给盒子通电,然后等着刷机完成就行了。 这就是整个刷机步骤,很简单吧? ::(呵呵) 但是吧,实操就不是这样了,因为适配的线刷固件是个大问题。 我找了不少的搜索引擎、论坛、网盘,只找到了几个 CA 版四川电信的盒子线刷固件,并且都是适配 8G 版本的华为悦盒,对比了一下文件结构和大小,最后发现有好几个是同一份文件 ::(挖鼻) ,其他还找到了很多诸如“update.zip”的这类卡刷包以及线刷的 fastboot、recovery 等文件,然而卡刷包对于线刷并没有什么卵用。 鉴于找不到完全适配的线刷固件,所以只能凑活用这个四川电信的 CA 固件了。刚开始我还没有什么思路,我就抱着死马当活马医的心态想着给盒子刷这个固件试试,看能不能刷进去。 点击“刷写”不到一分钟,不出意外地控制台就报错了: 第一点提示说是“烧写的 Fastboot 镜像与当前单板型号或 Flash 不匹配导致”,那就可能是 fastboot 文件的问题?此时我灵机一动,正好有之前下载到的适配我这个盒子的 fastboot 文件啊,于是我就用下载到的 fastboot 文件替换了刷机固件下的 fastboot 文件,然后继续刷机。 果然,这下子没有报错,显示开始刷机了,刷的时间比较长,四十几分钟后提示烧写完成: 2.3、系统启动 我一下来了精神,没想到瞎猫碰到死耗子,竟然真就给刷进去了。我连忙给盒子接到电视上,找出吃灰了两年的遥控器,塞两节电池之后开始开机,果然就见到了那个熟悉的界面: 接下来系统开始进行初始化走进度条,就在我以为救砖成功的时候,进度条卡在了 50% 不动弹了,提示“接入网络故障”: 可问题是我已经给盒子插了网线了啊,莫非是要连接光猫上的“iTV”接口?试了连接到光猫上的网口还是卡在这里,我想着要不然恢复一遍出厂设置吧,结果恢复完之后提示信息又变成“通路故障或AAA认证失败”了: 行吧,虽然依然没进去系统,至少比变砖强点。 这时候想起网上不少的刷机教程,都提到了卡刷这个方式,于是我也下了好几个卡刷包想着试一试卡刷,将刷机文件在硬盘根目录与“upgrade”文件夹各放了一份,开机通过电源键进入 Recovery,选择 “Apply update from external storage(从外部存储更新)”选项卡刷,但是要么直接提示“更新失败”,要么就是好不容易开始更新了,结果一会之后卡进度条还是提示更新失败。 起初我还怀疑是不是刷机包给下错了,但我试了好几个之后都不行之后就大概确定不是了,再尝试了一下短接 J15 针脚强刷,依然没有任何反应,卡在这了。 后面看到这一篇帖子华为悦盒通用刷机救砖破解教程_华为悦盒/华为盒子 ROM固件_小白刷机网 (xiaobaishuaji.com)中提到的更新了签名会导致卡刷失败,按这里面提到的方式刷机前进行一次“三清”,这不清不重要,清完之后启动的时候结果直接变砖无法启动 :@(喷血) ,.......无奈。 三、破解 在这个界面卡了好长时间,结果发现其实按遥控器上的设置建是可以进入设置菜单的,但需要操作码,网上查了一下,我用“6321”进去了。 操作码大概可能有这么多个:一般是运营商客服电话(10000、10086、10010),除此之外还有:8288、6321、2878、3008、8005、1301、123456等,都没有用的话,可以试试专家模式密码189189 来自:华为悦盒ec6108v9高级设置操作码常用汇总 到设置界面看了一下设备信息,我大概知道为什么卡刷失败了,因为这个盒子从 pub 版本被刷成 CA 版的了: 到这里的话,我对卡刷是不报什么希望了。但是好在盒子已经能启动了,虽然还没办法通过系统自带的 IPTV 是进入桌面,但是能进设置界面啊,那就存在破解安装当贝桌面的可能性,然后绕过 IPTV 进入系统当贝桌面。 关于破解华为悦盒安装第三方桌面的步骤,在 ZNDS 论坛的这篇帖子 最新华为悦盒V9_V9U_V9E_V9A_V8通用傻瓜式刷机包!_华为悦盒_ZNDS 里已经写挺详细的,我就懒得写了,直接参考这篇帖子就可以。破解工具在文末。 接下来就比较顺了,破解果然是可以的,破解重启之后就有选择桌面的弹窗了: 四、后续 破解完成之后,安装了几个软件用了一会,体验吧只能说很一般,目前主流的视频软件操作起来卡卡的,盒子发热还比较严重(虽然不摸是感觉不出来的),并且遥控器上的首页按键是没有响应的(估计可能是固件问题)。当然还是不能用太高的要求来评价它,毕竟盒子是七八年前了,实在太老了,就连 CPU 还是 32 位,性能放在今天来看实在是有点捉急。综合来说,安装一个直播软件来看电视直播是比较好的选择。 到这我就准备要收拾家伙事儿不搞了,然后我就在网上又发现了一个线刷固件,适用于 8G 版本盒子,我想着最后尝试一下吧,下载替换 fastboot 文件一气呵成,刷固件依然花了四十多分钟。启动之后还是卡在了运营商自带的 IPTV 界面,进入设置界面查看设备信息之后,发现这个固件是浙江的移动百盒固件,不过是 PUB 版本的,还行,比之前的那个 CA 固件强,用卡刷的方式尝试了一下刷第三方系统,是可以正常刷第三方系统的。因此把这个固件下载链接也放在了文末,有需要的话用这个也行。 最后用卡刷的方式刷入电信的原厂固件,再破解就行了,本来想着还能再认证一下使用 IPTV 来看电视的,但是我尝试之后发现这边的 IPTV 认证地址竟然都挂了,所以就干脆放弃了。 五、碰到的坑 这里记录几个我在刷机过程中碰到的问题,以供参考。碰到问题与报错不要怕,仔细查看分析控制台输出与报错,多猜多尝试。 5.1、关于在刷机前配置板端ip的问题 刚开始我并没有注意到这个问题,所以开始刷机时都是报错: 第一次我还不信邪,多尝试了几次之后我就意识到了问题:我的电视盒子都开不了机了,连接到网线之后路由器后台根本识别不到这个设备,那么现在设置的 IP 地址肯定是无效的呀。 这就是我碰到的第一个大坑,研究了一会我的解决办法是,给家里吃灰的一个旧路由器插上电,用这个路由器来组网,这个局域网里面就只有盒子和笔记本两台设备,修改 HiToll 设置里的 IP 地址,板端 IP 同样随便设置(不能跟笔记本 IP 重复),这下刷机就可以了。 所以关于这个问题我的猜测是这样的(计算机网络学的不好,猜错了大佬轻喷 ::(小红脸) ):当局域网中设备比较多的时候,笔记本将刷机数据通过路由器给下一个结点传输的时候,设备太多就导致无法确定目标传输设备,所以就会连接超时报错,相反如果只有两个设备的话,路由器传输数据时不是传输给盒子就是传输给笔记本,传输给笔记本应该是不太可能,所以就只能将数据传输给另一设备,这么阴差阳错地就完成了传输。 怎么莫名有种玄学的感觉?? ::(笑尿) 5.2、发送数据帧失败,请检查串口连接是否正常 刚点击刷写以后,控制这样报错: 以我的情况来看,是 fastboot 文件没有选对,换了适配设备的 fastboot 文件就不报错了。 文末再放上几个刷机查资料过程中发现的几个有用的帖子吧,供有需要的参考: 海思hi3798mv100机型通用twrp_华为悦盒_ZNDS 华为悦盒怎么进入REC模式升级双清恢复出厂设置最全方法_华为悦盒_ZNDS 河南移动cmcc-2 ch电视盒子Hi3798MV310线刷-卡刷-刷机-救砖 - 知乎 (zhihu.com) ec6108v9c刷回安卓看电视 - 海思机顶盒NAS社区 (histb.com) 关于hitool刷写... - 海思机顶盒NAS社区 (histb.com) 华为悦盒EC6108V9 CA高安版1+4G电信4K机顶盒拆机救砖文件TTL线刷 | 西安艾金达贸易有限公司 (aijinda.cn) 华为 悦盒EC6108V9_PUB-8G内存版线刷救砖软件下载_怎么安装第三方软件_应用APP下载_沙发管家 (shafa.com) 【已解决】 EC6108V9 等待boot启动超时,单板上无fastboot或当..._华为悦盒_ZNDS 文件下载链接: https://pan.baidu.com/s/1OZdZQRhWsE49pto_oAzbwQ?pwd=xy6m 提取码: xy6m

关于华为悦盒EC6108V9的一种比较另类的救砖方法 目录: 一、前期准备 1.1、USB转TTL模块 1.2、主板上焊接针脚 二、HiTool 线刷 2.1、跑码 2.2、开始刷机 2.3、系统启动 三、破解 四、后续 五、碰到的坑 5.1、关于在刷机前配置板端ip的问题 5.2、发送数据帧失败,请检查串口连接是否正常 我手上的这个电视盒子,是2016 年家里办宽带的时候电信送的,在 2020 年疫情期间被我刷机给变砖了 :@(狂汗) 。盒子接上电源开机的时候电视完全没有反应,左边绿灯与中间红灯常亮,Recovery 进不去,使用遥控器也没有任何反应。当时还抱着卡刷救砖的希望,尝试了网上说的短接 J15 针脚强制刷机,结果一点用也没有,然后淘宝又买了 TTL 转 USB 模块准备线刷救砖,买来还没操作就被网上那些教程吓住了,再加上那段时间打游戏也打的火热,这个事也就被无限期搁置了(拖延症晚期患者 ::(酸爽) )。后来直接就买了斐讯 N1,转 N1 的阵营了,一直用到了现在。直到前两天在 B 站刷到这个将华为悦盒刷成 Ubuntu 服务器的视频: {bilibili bvid="BV1Y3411V77b" page=""/} 这个视频让我又有了天晴了雨停了我又觉得我行了的感觉,正好这几天毕业答辩的事也忙完闲下来了,所以花了一(亿)点点时间做一下最后救砖的尝试,当然最后算是成功了,所以写这篇博客来记录一下,为同样变砖的同志提供一个救砖的参考方法。 事先在此说明:这是在华为悦盒使用卡刷、强制卡刷都没有办法救砖时,并且还找不到更适配的固件的情况下,我摸索出来的一个比较另类的救砖方法,目前这个方法只在我的这个盒子上成功了,其他的盒子还没有试过(也没有条件尝试),因此并不能保证这个方法的通用性。在 ZNDS 论坛上有个类似的方式是这个(不过我并没有尝试成功)。 如果你是老司机了,那么本文救砖的方式可以试一试,救砖成功那么恭喜你,如果尝试多次还不成功的话那建议再去找找别的方式,相反如果你此前没有过刷机的经验或者经验不足,且无法独立解决报错问题,那么强烈建议慎用本文所提供的方法!! 在刷机过程中造成的损坏恕博主不能负责!!! 在刷机过程中造成的损坏恕博主不能负责!!! 在刷机过程中造成的损坏恕博主不能负责!!! 首先说明一下我手上这个盒子的型号规格:型号为华为悦盒 EC6108V9,用的 CPU 型号是 Hi3798MV100,存储规格为 1G + 4G。 型号信息: 主板布局: 一、前期准备 1.1、USB转TTL模块 线刷需要 USB 转 TTL 模块,淘宝几块钱就能买到还送杜邦线,就是这玩意: 无脑买型号是 CH340 的就行,看网上说大部分 CH340 免驱动,但是我手上这个不是,所以建议到时候跟卖家问清楚再买。甚至只要你愿意多花几块钱,还可以买到土豪金配色的(刷机时有神秘 buff 加成 :@(吐舌) )。 刷机之前检验一下 TTL 模块是否需要驱动,模块插到电脑上之后,在设备管理器 -> 端口选项下面会显示硬件名称跟端口: 如果不显示的话应该是没有驱动,打开 Win10 更新 -> 检查更新,有更新的话就点击安装就行: 1.2、主板上焊接针脚 此外还需要在电视盒子主板的 GND、RX、TX 这三个脚位上焊接三个排针,方便用杜邦线连接 TTL 模块,最后效果是这样: 需要注意的是盒子主板与 TTL 模块针脚连接的对应关系:模块的 GND 脚连接主板的 GND 脚,模块的 RX 与 TX 与主板要反着连,即模块的 RX 连接主板的 TX,TX 连接主板的 RX。 二、HiTool 线刷 线刷工具用到 HiTool,下载地址放在文末。这个软件需要 Java 环境,如果打开报错的话就配置一下 Java 环境,配置方法参考这篇博客:Win10系统配置Java开发环境 - Roookie博客 | 记录 · 收纳 · 分享 (wlplove.com)。 软件启动之后,首先要选择芯片平台,我选择了“Hi3798MV100”,然后进入软件,打开 “HiBurn”模块,这就是线刷需要用到的功能。 2.1、跑码 开始刷机前,简单介绍一下“跑码”。 这个操作在刷机失败之后查找错误原因是非常有用的。我刚开始查资料时看到网上很多人都提到了“跑码”这个词,弄得我一脸懵逼,不过跟着操作了以后就大概理解什么意思了,简单来说,跑码会在硬件启动过程中输出硬件信息、一些提示信息,也会在出现错误的时候输出错误代码,对定位硬件启动的错误有很大的帮助。 在软件菜单栏上点击这个图标打开终端窗口: 在打开的终端窗口上前三个按钮的功能分别是连接、断开连接、设置: 连接前先点击设置按钮配置一下连接端口,端口就是前面设备管理器里显示的 TTL 模块的端口: 设置完成之后,点击连接按钮,然后给盒子通电,首先会在终端输出当前设备的硬件信息,然后盒子会尝试启动系统,同时在终端输出启动过程中的提示信息,比如刚开始我的盒子就是一直循环输出同一段报错信息: 看报错信息应该是在尝试启动的过程中卡在了 fastboot 上。 2.2、开始刷机 相关文件链接已放在文末。 给盒子断电并连接网线,在软件里配置本机与盒子的 IP 地址: 串口:设备管理器里显示的 TTL 模块的连接端口 服务器 IP:本机的 IP 地址 IP 地址:网络盒子的 IP,可以不用改 网关:路由器的 IP 然后找到下方的“烧写eMMC”: 选择刷机文件目录下面的 “xml” 分区表文件,下方表格中就会自动导入相关的分区镜像,选择要刷入的分区文件,点击烧写,当下面控制台出来提示以后给盒子通电,然后等着刷机完成就行了。 这就是整个刷机步骤,很简单吧? ::(呵呵) 但是吧,实操就不是这样了,因为适配的线刷固件是个大问题。 我找了不少的搜索引擎、论坛、网盘,只找到了几个 CA 版四川电信的盒子线刷固件,并且都是适配 8G 版本的华为悦盒,对比了一下文件结构和大小,最后发现有好几个是同一份文件 ::(挖鼻) ,其他还找到了很多诸如“update.zip”的这类卡刷包以及线刷的 fastboot、recovery 等文件,然而卡刷包对于线刷并没有什么卵用。 鉴于找不到完全适配的线刷固件,所以只能凑活用这个四川电信的 CA 固件了。刚开始我还没有什么思路,我就抱着死马当活马医的心态想着给盒子刷这个固件试试,看能不能刷进去。 点击“刷写”不到一分钟,不出意外地控制台就报错了: 第一点提示说是“烧写的 Fastboot 镜像与当前单板型号或 Flash 不匹配导致”,那就可能是 fastboot 文件的问题?此时我灵机一动,正好有之前下载到的适配我这个盒子的 fastboot 文件啊,于是我就用下载到的 fastboot 文件替换了刷机固件下的 fastboot 文件,然后继续刷机。 果然,这下子没有报错,显示开始刷机了,刷的时间比较长,四十几分钟后提示烧写完成: 2.3、系统启动 我一下来了精神,没想到瞎猫碰到死耗子,竟然真就给刷进去了。我连忙给盒子接到电视上,找出吃灰了两年的遥控器,塞两节电池之后开始开机,果然就见到了那个熟悉的界面: 接下来系统开始进行初始化走进度条,就在我以为救砖成功的时候,进度条卡在了 50% 不动弹了,提示“接入网络故障”: 可问题是我已经给盒子插了网线了啊,莫非是要连接光猫上的“iTV”接口?试了连接到光猫上的网口还是卡在这里,我想着要不然恢复一遍出厂设置吧,结果恢复完之后提示信息又变成“通路故障或AAA认证失败”了: 行吧,虽然依然没进去系统,至少比变砖强点。 这时候想起网上不少的刷机教程,都提到了卡刷这个方式,于是我也下了好几个卡刷包想着试一试卡刷,将刷机文件在硬盘根目录与“upgrade”文件夹各放了一份,开机通过电源键进入 Recovery,选择 “Apply update from external storage(从外部存储更新)”选项卡刷,但是要么直接提示“更新失败”,要么就是好不容易开始更新了,结果一会之后卡进度条还是提示更新失败。 起初我还怀疑是不是刷机包给下错了,但我试了好几个之后都不行之后就大概确定不是了,再尝试了一下短接 J15 针脚强刷,依然没有任何反应,卡在这了。 后面看到这一篇帖子华为悦盒通用刷机救砖破解教程_华为悦盒/华为盒子 ROM固件_小白刷机网 (xiaobaishuaji.com)中提到的更新了签名会导致卡刷失败,按这里面提到的方式刷机前进行一次“三清”,这不清不重要,清完之后启动的时候结果直接变砖无法启动 :@(喷血) ,.......无奈。 三、破解 在这个界面卡了好长时间,结果发现其实按遥控器上的设置建是可以进入设置菜单的,但需要操作码,网上查了一下,我用“6321”进去了。 操作码大概可能有这么多个:一般是运营商客服电话(10000、10086、10010),除此之外还有:8288、6321、2878、3008、8005、1301、123456等,都没有用的话,可以试试专家模式密码189189 来自:华为悦盒ec6108v9高级设置操作码常用汇总 到设置界面看了一下设备信息,我大概知道为什么卡刷失败了,因为这个盒子从 pub 版本被刷成 CA 版的了: 到这里的话,我对卡刷是不报什么希望了。但是好在盒子已经能启动了,虽然还没办法通过系统自带的 IPTV 是进入桌面,但是能进设置界面啊,那就存在破解安装当贝桌面的可能性,然后绕过 IPTV 进入系统当贝桌面。 关于破解华为悦盒安装第三方桌面的步骤,在 ZNDS 论坛的这篇帖子 最新华为悦盒V9_V9U_V9E_V9A_V8通用傻瓜式刷机包!_华为悦盒_ZNDS 里已经写挺详细的,我就懒得写了,直接参考这篇帖子就可以。破解工具在文末。 接下来就比较顺了,破解果然是可以的,破解重启之后就有选择桌面的弹窗了: 四、后续 破解完成之后,安装了几个软件用了一会,体验吧只能说很一般,目前主流的视频软件操作起来卡卡的,盒子发热还比较严重(虽然不摸是感觉不出来的),并且遥控器上的首页按键是没有响应的(估计可能是固件问题)。当然还是不能用太高的要求来评价它,毕竟盒子是七八年前了,实在太老了,就连 CPU 还是 32 位,性能放在今天来看实在是有点捉急。综合来说,安装一个直播软件来看电视直播是比较好的选择。 到这我就准备要收拾家伙事儿不搞了,然后我就在网上又发现了一个线刷固件,适用于 8G 版本盒子,我想着最后尝试一下吧,下载替换 fastboot 文件一气呵成,刷固件依然花了四十多分钟。启动之后还是卡在了运营商自带的 IPTV 界面,进入设置界面查看设备信息之后,发现这个固件是浙江的移动百盒固件,不过是 PUB 版本的,还行,比之前的那个 CA 固件强,用卡刷的方式尝试了一下刷第三方系统,是可以正常刷第三方系统的。因此把这个固件下载链接也放在了文末,有需要的话用这个也行。 最后用卡刷的方式刷入电信的原厂固件,再破解就行了,本来想着还能再认证一下使用 IPTV 来看电视的,但是我尝试之后发现这边的 IPTV 认证地址竟然都挂了,所以就干脆放弃了。 五、碰到的坑 这里记录几个我在刷机过程中碰到的问题,以供参考。碰到问题与报错不要怕,仔细查看分析控制台输出与报错,多猜多尝试。 5.1、关于在刷机前配置板端ip的问题 刚开始我并没有注意到这个问题,所以开始刷机时都是报错: 第一次我还不信邪,多尝试了几次之后我就意识到了问题:我的电视盒子都开不了机了,连接到网线之后路由器后台根本识别不到这个设备,那么现在设置的 IP 地址肯定是无效的呀。 这就是我碰到的第一个大坑,研究了一会我的解决办法是,给家里吃灰的一个旧路由器插上电,用这个路由器来组网,这个局域网里面就只有盒子和笔记本两台设备,修改 HiToll 设置里的 IP 地址,板端 IP 同样随便设置(不能跟笔记本 IP 重复),这下刷机就可以了。 所以关于这个问题我的猜测是这样的(计算机网络学的不好,猜错了大佬轻喷 ::(小红脸) ):当局域网中设备比较多的时候,笔记本将刷机数据通过路由器给下一个结点传输的时候,设备太多就导致无法确定目标传输设备,所以就会连接超时报错,相反如果只有两个设备的话,路由器传输数据时不是传输给盒子就是传输给笔记本,传输给笔记本应该是不太可能,所以就只能将数据传输给另一设备,这么阴差阳错地就完成了传输。 怎么莫名有种玄学的感觉?? ::(笑尿) 5.2、发送数据帧失败,请检查串口连接是否正常 刚点击刷写以后,控制这样报错: 以我的情况来看,是 fastboot 文件没有选对,换了适配设备的 fastboot 文件就不报错了。 文末再放上几个刷机查资料过程中发现的几个有用的帖子吧,供有需要的参考: 海思hi3798mv100机型通用twrp_华为悦盒_ZNDS 华为悦盒怎么进入REC模式升级双清恢复出厂设置最全方法_华为悦盒_ZNDS 河南移动cmcc-2 ch电视盒子Hi3798MV310线刷-卡刷-刷机-救砖 - 知乎 (zhihu.com) ec6108v9c刷回安卓看电视 - 海思机顶盒NAS社区 (histb.com) 关于hitool刷写... - 海思机顶盒NAS社区 (histb.com) 华为悦盒EC6108V9 CA高安版1+4G电信4K机顶盒拆机救砖文件TTL线刷 | 西安艾金达贸易有限公司 (aijinda.cn) 华为 悦盒EC6108V9_PUB-8G内存版线刷救砖软件下载_怎么安装第三方软件_应用APP下载_沙发管家 (shafa.com) 【已解决】 EC6108V9 等待boot启动超时,单板上无fastboot或当..._华为悦盒_ZNDS 文件下载链接: https://pan.baidu.com/s/1OZdZQRhWsE49pto_oAzbwQ?pwd=xy6m 提取码: xy6m -

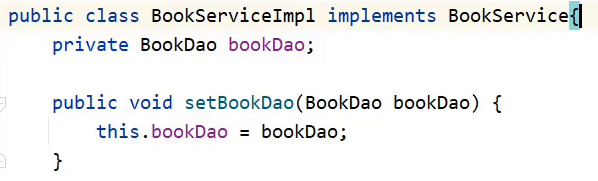

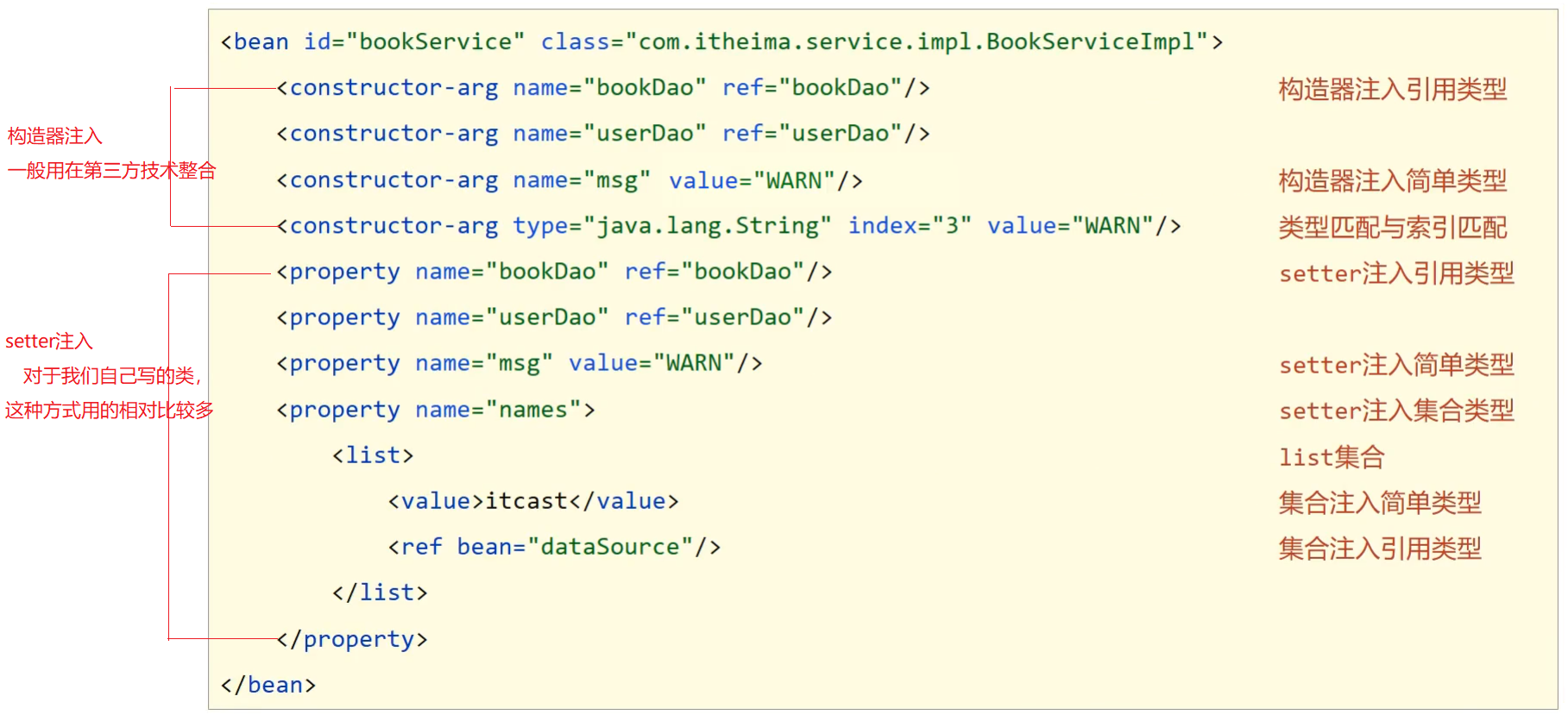

SpringMVC学习笔记 目录 一、SpringMVC介绍 二、映射请求路径 2.1、使用@ResquestMapping进行路径映射 2.2、@ResquestMapping的属性 2.2.1、value或path 2.2.2、method 2.2.3、params 2.2.4、headers 2.2.5、consumes 2.2.6、produces 2.3、@ResquestMapping的衍生注解 三、请求参数传递 3.1、GET/POST请求传递基础参数 3.2、传递复杂参数 3.2.1、日期类型 3.2.2、引用类型 3.2.3、数组 3.2.4、集合(List/Set/Map) 3.3、传递Json数据 四、响应 4.1、返回Json数据 4.2、封装返回结果 五、REST风格 5.1、简介 5.2、规则 5.3、相关注解 5.3.1、@RestController 5.3.2、@PathVariable 5.3.3、@RequestParam 5.3.4、@RequestBody 5.4、Rest风格开发示例 5.3.1、查询 5.3.2、新增 5.3.3、修改(更新) 5.3.4、删除 六、异常处理 6.1、自定义异常 6.2、处理异常的方式 6.2.1、使用@ControllerAdvice和@ExceptionHandler 6.2.2、实现HandlerExceptionResolver接口 七、拦截器 7.1、创建拦截器 7.2、注册和配置拦截器 7.3、执行流程和顺序 一、SpringMVC介绍 Spring MVC 是 Spring 框架中的一个模块,专门用于构建基于模型-视图-控制器(Model-View-Controller,MVC)设计模式的 Web 应用程序。 相关依赖坐标: <!-- https://mvnrepository.com/artifact/javax.servlet/javax.servlet-api --> <dependency> <groupId>javax.servlet</groupId> <artifactId>javax.servlet-api</artifactId> <version>3.1.0</version> <scope>provided</scope> </dependency> <!-- https://mvnrepository.com/artifact/org.springframework/spring-webmvc --> <dependency> <groupId>org.springframework</groupId> <artifactId>spring-webmvc</artifactId> <version>5.2.0.RELEASE</version> </dependency> 在 IDEA 中根据 “maven-archetype-webapp” 模板创建 Webapp 项目: 创建基本项目结构: 在 config 包里面新建初始化 Servlet 的配置类: public class ServletContainersInitConfig extends AbstractAnnotationConfigDispatcherServletInitializer { protected Class<?>[] getRootConfigClasses() { return new Class[]{SpringConfig.class}; } protected Class<?>[] getServletConfigClasses() { return new Class[]{SpringMvcConfig.class}; } protected String[] getServletMappings() { return new String[]{"/"}; } } 再新建 SpringMVC 配置类: @Configuration @ComponentScan("com.wlplove.controller") public class SpringMvcConfig { } 二、映射请求路径 2.1、使用@ResquestMapping进行路径映射 @RequestMapping 是 Spring MVC 中将 HTTP 请求映射到控制器方法的注解,它用于类级别或方法级别,可以根据请求的 URL、HTTP 请求方法(GET、POST 等)、请求参数、请求头等信息来匹配对应的处理逻辑。 @RequestMapping 注解应用在方法上,可以为该方法映射 URL 请求路径: public class UserController { @RequestMapping("/save") public String save() { // ... } } 也可以应用在类上,为该类中的所有方法设置基础的 URL 请求路径: @RequestMapping("/user") public class UserController { @RequestMapping("/save") public void save() { // ... } @RequestMapping("/delete") public void delete() { // ... } } 2.2、@ResquestMapping的属性 2.2.1、value或path 这两个属性作用相同,用于指定 URL 请求路径。用一个字符串映射一个路径,也可以用一个字符串数组映射多个路径。 @RequestMapping(value = "/save") @RequestMapping(path = "/save") // 映射多个路径 @RequestMapping(value = {"/save", "/saveUser"}) @RequestMapping(path = {"/save", "/saveUser"}) 一般也可以简写: @RequestMapping("/save") // 映射多个路径 @RequestMapping({"/save", "/saveUser"}) 2.2.2、method method 属性用于指定处理的 HTTP 方法。可以是一个 RequestMethod 枚举值或枚举值数组,常见的请求方法有 GET、POST、PUT、DELETE 等。 public class UserController { // save方法只处理POST和GET请求,路径为/save @RequestMapping(value = "/save", method = {RequestMethod.POST, RequestMethod.GET}) @ResponseBody public String save() { // ... } } 2.2.3、params 用于指定请求中必须包含的请求参数和值。可以使用一些特殊的表达式,如 paramName 表示请求中必须包含 paramName 参数;!paramName 表示请求中不能包含 paramName 参数,paramName=value 表示请求中 paramName 参数的值必须为 value。 // 请求中必须包含name参数 @RequestMapping(value = "/save", params = "name") // 请求中不能包含name参数 @RequestMapping(value = "/save", params = "!name") // 请求中name参数的值必须是123 @RequestMapping(value = "/save", params = "name=123") // 请求中name参数的值不能是123 @RequestMapping(value = "/save", params = "name!=123") 2.2.4、headers 用于指定请求中必须包含的请求头及其值,用法与 params 类似。 // 只有当请求/download路径的Accept头的值为application/pdf时,downloadPdf方法才会被调用 @RequestMapping(value = "/download", headers = "Accept=application/pdf") @ResponseBody public String downloadPdf() { // ... } 2.2.5、consumes 用于指定请求的内容类型(Content-Type),即客户端发送给服务器的数据的格式。 // uploadJson方法只处理Content-Type为application/json的请求 @RequestMapping(value = "/upload", consumes = "application/json") @ResponseBody public String uploadJson() { // ... } 2.2.6、produces 用于指定响应的内容类型(Accept),即服务器返回给客户端的数据的格式。 // getHtml方法返回的响应内容类型为text/html @RequestMapping(value = "/get", produces = "text/html") @ResponseBody public String getHtml() { return "<html><body>Hello</body></html>"; } 2.3、@ResquestMapping的衍生注解 为了简化代码,Spring 还提供了一些 @RequestMapping 的衍生注解,它们实际上是 @RequestMapping(method = xxx) 的特定形式: @GetMapping:等同于 @RequestMapping(method = RequestMethod.GET),用于处理 HTTP Get 请求 @PostMapping:等同于 @RequestMapping(method = RequestMethod.POST),用于处理 HTTP Post 请求 @PutMapping:等同于 @RequestMapping(method = RequestMethod.PUT),用于处理 HTTP Put 请求 @DeleteMapping:等同于 @RequestMapping(method = RequestMethod.DELETE),用于处理 HTTP Delet 请求 @PatchMapping:等同于 @RequestMapping(method = RequestMethod.PATCH),用于处理 HTTP Patch 请求 三、请求参数传递 3.1、GET/POST请求传递基础参数 GET 请求的参数通过 URL 传递,附加在 URL 后面,形式为查询字符串(Query String),例如: http://localhost:8080/save?name=Jerry&age=13 POST 请求数据通过请求体(Request Body)传递,不会显示在 URL 中,在 Postman 中使用传递参数: 在 Java 的控制器方法中使用相同名称的形参,SpringMVC 可以自动将请求参数绑定到控制器方法中同名的形参上: @Controller public class UserController { // 如果要限制使用特定请求方法(POST/GET),将RequestMapping换成PostMapping或者GetMapping即可 @RequestMapping("/save") @ResponseBody public String save(String name, int age) { // ... } } 除此之外,SpringMVC 也支持将请求参数映射到不同名称的形参上,需要用 @RequestParam 注解指定请求参数绑定到控制器方法的哪个形参上: @Controller public class UserController { @RequestMapping("/save") @ResponseBody public String save(@RequestParam("name")String userName, @RequestParam("age")int userAge) { // ... } } @RquestParam 注解的属性: value 或 name:指定请求参数的名称。如果省略,默认使用控制器方法的形参名作为参数名称。 required:指定参数是否为必填项。默认值为 true,表示请求中必须包含该参数,如果请求中缺少该参数,Spring 会抛出 MissingServletRequestParameterException。如果设置为 false,则参数可以为空。 defaultValue:指定参数的默认值。如果请求中未提供该参数,则使用该默认值。 3.2、传递复杂参数 3.2.1、日期类型 在请求中传递特定格式的日期: http://localhost:8080/save?date=2023-10-12 在控制层方法的形参前面加上 @DateTimeFormat 注解并指定日期格式,SpringMVC 就可以将同名请求参数转换为日期格式: @RequestMapping("/dateParse") @ResponseBody public String dateParse(@DateTimeFormat(pattern = "yyyy-MM-dd") Date date) { // ... } 3.2.2、引用类型 例如存在一个 User 对象,其中包含一个引用类型的成员 address: public class Address { // 省 private String province; // 市 private String city; } public class User { // 姓名 private String name; // 年龄 private String age; // 地址——引用对象 private Address address; } 控制器方法中使用 User 对象接收参数: @Controller public class UserController { @RequestMapping("/save") @ResponseBody public String save(User user) { // ... } } 那么在请求中传递参数时保持参数名与控制器方法形参名相同即可(不相同时使用 @RequestParam 绑定): GET: http://localhost:8080/save?name=Jerry&age=13&address.province=河南&address.city=开封 POST: 3.2.3、数组 控制器方法中使用数组接收参数: @Controller public class UserController { @RequestMapping("/save") @ResponseBody public String save(String[] nameArray) { // ... } } 那么在请求中传递参数时都使用相同名称的参数即可: GET: http://localhost:8080/save?nameArray=Jerry&nameArray=Tom&nameArray=Mike POST: 3.2.4、集合(List/Set/Map) 控制器方法中使用集合接收参数(形参前需要加 @RequestParam 注解): @Controller public class UserController { @RequestMapping("/save") @ResponseBody public String save(@RequestParam List<String> nameList) { // ... } } 在请求中传递参数的方式与数组相同: GET: http://localhost:8080/save?nameArray=Jerry&nameArray=Tom&nameArray=Mike POST: 3.3、传递Json数据 添加处理 Java 对象与 JSON 数据相互转换的依赖坐标: <!-- https://mvnrepository.com/artifact/com.fasterxml.jackson.core/jackson-databind --> <dependency> <groupId>com.fasterxml.jackson.core</groupId> <artifactId>jackson-databind</artifactId> <version>2.18.2</version> </dependency> 在 SpringMVC 配置上添加 @EnableWebMvc 注解开启 Spring MVC 的默认配置(其中包括 Java 对象与 JSON 数据的相互转换): @Configuration @ComponentScan("com.wlplove.controller") @EnableWebMvc public class SpringMvcConfig { // ... } 发送的 JSON 数据: { "name": "Tom", "age": 12 } 控制器方法中用集合或者对象接收时形参前加上 @RequestBody 注解将请求体中的数据绑定到控制器方法的参数上: @RequestMapping("/json") @ResponseBody public String json2Dto(@RequestBody User user) { // ... } 四、响应 4.1、返回Json数据 需要添加 Jackson 的依赖: <!-- https://mvnrepository.com/artifact/com.fasterxml.jackson.core/jackson-databind --> <dependency> <groupId>com.fasterxml.jackson.core</groupId> <artifactId>jackson-databind</artifactId> <version>2.18.2</version> </dependency> 在控制器方法上使用 @ResponseBody 注解,告知 SpringMVC 将控制层方法的返回值直接写进 HTTP 响应体,而不是解析为视图。最后 SpringMVC 通过 HttpMessageConverter 接口将返回值转换为适当的格式(如 JSON、XML等)。 @RequestMapping("/returnJson") @ResponseBody public User returnJson() { User user = new User(); user.setAge(20); user.setName("QWERT"); return user; } @ResponseBody 支持的返回值类型: 基本类型(String、int、boolean 等)。 自定义对象(User、Product 等)。 集合或数组(List<User>、String[] 等)。 4.2、封装返回结果 新建一个返回结果对象: public class Result { /** 状态码 */ private Integer code; /** 返回内容 */ private String msg; /** 数据对象 */ private Object data; public Result(Integer code, Object data) { this.code = code; this.data = data; } public Result(Integer code, String msg, Object data) { this.code = code; this.msg = msg; this.data = data; } // get和set方法 } 自定义返回编码: public class Code { public static final Integer OK = 000000; public static final Integer ERR =999999; // 其他编码 } 对 controller 方法的返回值都统一成这个返回对象: @Controller @RequestMapping("/users") public class UserController { @Autowired private UserMapper userMapper; @RequestMapping("/{id}") @ResponseBody public Result findById(@PathVariable Integer id) { User user = userMapper.selectById(id); Integer code = user != null ? Code.OK : Code.ERR; String msg = user != null ? "数据查询成功" : "数据查询失败"; return new Result(code, msg, user); } // ... } 五、REST风格 5.1、简介 REST(Representational State Transfer)风格是一种软件架构风格,用于设计网络应用程序,其核心概念旨在通过 HTTP 协议实现客户端与服务器之间简洁、可扩展且高效的交互。 传统风格资源描述形式: http://lcoalhost/user/getById?id=1 http://localhost/user/saveUser REST风格描述形式: http://localhost/user/1 http://localhost/user REST 风格是一种设计接口的约定方式,并非规范。 5.2、规则 REST 使用统一的接口与服务器进行交互,基于 HTTP 协议的标准方法: GET 用于获取资源 POST 用于创建资源 PUT 用于更新资源 DELETE 用于删除资源 5.3、相关注解 5.3.1、@RestController @RestController 是 Spring 4.0 引入的一个组合注解,它是 @Controller 和 @ResponseBody 的结合体。其主要作用是将一个控制器类标记为使用 REST 风格,使用 @RestController 注解的类中的所有处理方法默认都会将返回值直接写入 HTTP 响应体,以 JSON、XML 等数据格式返回,而不是返回视图进行渲染。 5.3.2、@PathVariable @PathVariable 是 Spring MVC 中用于将 URL 中的模板变量绑定到控制器方法形参上的注解。它通常用于 RESTful API 中,从 URL 路径中提取参数值。 如根据 ID 查询用户的控制器方法: @GetMapping("/users/{id}") public String findById(@PathVariable Long id) { // ... } 那么对于 GET 请求链接 http://localhost/users/123456,该控制器可以通过 @PathVariable 将 “123456” 绑定到形参 id 上。 也支持在路径中定义多个路径变量: http://localhost/users/123456/orders/987654321 在控制器方法中接收多个参数: @GetMapping("/users/{userId}/orders/{orderId}") public Order getOrder(@PathVariable Long userId, @PathVariable Long orderId) { // ... } Spring MVC 5.3 及以上版本支持可选路径变量。如果路径变量是可选的,可以设置属性 required = false: @GetMapping("/users/{id}") public User getUser(@PathVariable(required = false) Long id) { if (id == null) { // 返回所有用户 return userService.getAllUsers(); } // 返回指定id的用户 return userService.getUserById(id); } 那么: http://localhost/users id为null,返回所有用户 http://lcoalhost/users/123 返回id为123的用户 5.3.3、@RequestParam 详见 3.1。 5.3.4、@RequestBody 详见 3.3。 5.4、Rest风格开发示例 5.3.1、查询 // 查询全部 @GetMapping("/users") public xxxResponse findAll() { // ... } // 根据主键查询 @GetMapping("/users/{id}") public xxxResponse findById(@PathVariable Long id) { // ... } 5.3.2、新增 @PostMapping("/users") public xxxResponse add(@RequestBody User user) { // ... } 5.3.3、修改(更新) @PutMapping("/users") public xxxResponse update(@RequestBody User user) { //... } 5.3.4、删除 @DeleteMapping("/delete/{id}") public xxxResponse delete(@PathVariable Long id) { // ... } 六、异常处理 6.1、自定义异常 新建一个自定义异常类 BusinessException: public class BusinessException extends RuntimeException { private Integer code; public BusinessException(Integer code, String message) { super(message); this.code = code; } // get和set方法 } 自定义异常编码: public class ErrorCode { public static final Integer TIMEOUT_ERROR = 10001; // 其他异常编码 } 在业务层代码中抛出异常: throw new BusinessException(ErrorCode.TIMEOUT_ERROR, "请求超时,请稍后再试"); 6.2、处理异常的方式 6.2.1、使用@ControllerAdvice和@ExceptionHandler @ControllerAdvice 是 Spring 框架提供的一个用于定义全局异常处理、数据绑定和数据预处理等逻辑的注解。在配合标注了 @ExceptionHandler 注解的方法使用时,可以在拦截到对应的异常之后终止原 controller 方法的执行,并转入该方法执行设定好的异常处理逻辑。 在 controller 包中新建一个全局异常处理类 GlobalExceptionHandler,在类中的方法上面使用 @ExceptionHandler 注解指定这个方法要处理哪种异常: @ControllerAdvice public class GlobalExceptionHandler { // Exception是所有异常的父类,在此表示拦截到所有的异常都会进行处理 @ExceptionHandler(Exception.class) // 方法参数中加入这种异常类型的形参,就可以获取到这个异常的信息 public ResponseEntity<String> doException(Exception ex) { return new ResponseEntity<>("异常信息: " + ex.getMessage()); } // 只处理RuntimeException异常 @ExceptionHandler(RuntimeException.class) public Response<T> doRuntimeException(RuntimeException ex){ // RuntimeException异常处理逻辑 } // 只处理IOException异常 @ExceptionHandler(IOException.class) public Response<T> doIOException(IOException ex){ // IOException异常处理逻辑 } // ... } 如果在控制器中使用 Rest 风格的开发,可以使用 @RestControllerAdvice 注解,@RestControllerAdvice 是 @ControllerAdvice 和 @ResponseBody 的组合注解,类中的方法返回值会自动进行 JSON 或 XML 等格式的序列化,直接作为响应体返回给客户端。 6.2.2、实现HandlerExceptionResolver接口 HandlerExceptionResolver 是 Spring Web 框架中的一个接口,它提供了一种统一处理控制器(@Controller)中抛出的异常的机制。通过实现这个接口,开发者可以自定义异常处理逻辑,以满足不同的业务需求,比如返回特定格式的错误响应、记录异常日志等。 处理异常主要通过该接口中的 resolveException 方法实现 方法参数: HttpServletRequest request:当前请求对象,通过它可以获取请求的各种信息,如请求头、请求参数等。 HttpServletResponse response:当前响应对象,可用于设置响应头、响应状态码等。 Object handler:处理当前请求的处理器对象,通常是一个控制器方法。 Exception ex:在处理请求过程中抛出的异常对象。 方法返回值: ModelAndView 是 Spring MVC 中用于封装视图和模型数据的类。如果返回 null,表示该异常解析器没有处理该异常,Spring 将继续尝试其他的异常解析器。如果返回一个非空的 ModelAndView 对象,Spring 会根据其中的视图信息渲染相应的视图,并将模型数据传递给视图。 新建一个异常处理类 CustomExceptionResolver,用 @Component 注解声明这是一个 Spring Bean,实现 HandlerExceptionResolver 接口中的 resolveException 方法: @Component public class CustomExceptionResolver implements HandlerExceptionResolver { public ModelAndView resolveException(HttpServletRequest request, HttpServletResponse response, Object handler, Exception ex) { ModelAndView modelAndView = new ModelAndView(); if (ex instanceof IllegalArgumentException) { modelAndView.setViewName("error/400"); // 跳转到 400 错误页面 modelAndView.addObject("errorMessage", "非法参数: " + ex.getMessage()); response.setStatus(HttpServletResponse.SC_BAD_REQUEST); } else { modelAndView.setViewName("error/500"); // 跳转到 500 错误页面 modelAndView.addObject("errorMessage", "服务器内部错误: " + ex.getMessage()); response.setStatus(HttpServletResponse.SC_INTERNAL_SERVER_ERROR); } return modelAndView; } } 七、拦截器 在 Spring 中,拦截器是利用 AOP(面向切面编程)的思想实现的一种机制,用在请求处理的不同阶段(如请求到达 controller 方法之前、controller 方法执行之后、视图渲染之前等)执行自定义逻辑,在以下的场景中广泛使用: 权限验证:在请求到达控制器之前,检查用户是否具有访问该资源的权限,如验证用户登录状态。 日志记录:记录请求的相关信息,如请求的 URL、参数、处理时间等,方便后续的调试和监控。 性能监控:统计请求的处理时间,找出性能瓶颈。 请求参数处理:对请求参数进行统一的预处理,如编码转换、参数验证等。 7.1、创建拦截器 在 controller 包中新建一个包 interceptor,创建拦截器类 ProjectInterceptor,实现 HandlerInterceptor 接口,并用 @Component 声明为一个 bean: @Component public class ProjectInterceptor implements HandlerInterceptor { // 在控制器处理请求之前调用 @Override public boolean preHandle(HttpServletRequest request, HttpServletResponse response, Object handler) throws Exception { // 通过handler对象经过反射可以获取到原controller方法 System.out.println("preHandle: 请求到达控制器之前"); // 可以在此处进行权限验证、日志记录等操作 // 如果返回 false,请求将被中断,不再执行postHandle与afterCompletion return true; } // 在控制器处理请求之后、视图渲染之前调用 @Override public void postHandle(HttpServletRequest request, HttpServletResponse response, Object handler, ModelAndView modelAndView) throws Exception { System.out.println("postHandle: 控制器处理请求之后"); // 可以在此处修改模型数据或视图 } // 在视图渲染完成之后调用(无论请求是否成功) @Override public void afterCompletion(HttpServletRequest request, HttpServletResponse response, Object handler, Exception ex) throws Exception { System.out.println("afterCompletion: 视图渲染完成之后"); // 可以在此处进行资源清理、日志记录等操作 } } 7.2、注册和配置拦截器 在 config 包下新建一个配置类 SpringMvcSupport,继承 WebMvcConfigurationSupport 类,并重写 addInterceptors 方法,在这个方法中注册和配置拦截器: @Configuration public class SpringMvcSupport extends WebMvcConfigurationSupport { // 注入之前定义好的拦截器类 @Autowired private ProjectInterceptor projectInterceptor; @Override public void addInterceptors(InterceptorRegistry registry) { registry.addInterceptor(projectInterceptor) // 指定要拦截的路径,可以传入多个路径 .addPathPatterns("/**") // 指定要排除的路径,可以传入多个路径 .excludePathPatterns("/login", "/register"); } } addPathPatterns 和 excludePathPatterns 方法均支持 Ant 风格的路径匹配规则,具体语法规则如下: ?:匹配单个字符。 示例:/user? 可以匹配 /user1、/userA,但不能匹配 /user12。 \*:匹配任意数量的字符(不包括路径分隔符 /)。 示例:/user/* 可以匹配 /user/123、/user/profile,但不能匹配 /user/123/address。 `\**:匹配任意数量的字符(包括路径分隔符/`)。 示例:/user/** 可以匹配 /user/123、/user/123/address。 {variable}:匹配路径变量。 示例:/user/{id} 可以匹配 /user/123,并将 123 绑定到路径变量 id 除了新建一个 SpringMvcSupport 配置类来配置拦截器的方法外,还可以让原来的 SpringMvc 配置类来实现 WebMvcConfigurer 接口中的 addInterceptors 方法,也能达到相同的效果: @Configuration @ComponentScan("com.xxx.controller") @EnableWebMvc public class SpringMvcSupport implements WebMvcConfigurer { // 注入之前定义好的拦截器类 @Autowired private ProjectInterceptor projectInterceptor; @Override public void addInterceptors(InterceptorRegistry registry) { registry.addInterceptor(projectInterceptor) // 指定要拦截的路径,可以传入多个路径 .addPathPatterns("/**") // 指定要排除的路径,可以传入多个路径 .excludePathPatterns("/login", "/register"); } } 7.3、执行流程和顺序 拦截器执行流程: 如果有多个拦截器,形成拦截器链,它们的执行顺序如下: preHandle:按照注册顺序依次执行,必定运行。 postHandle:按照注册顺序的逆序执行,可能不运行。 afterCompletion:按照注册顺序的逆序执行,可能不运行。 例如拦截器 A、B、C 按顺序注册: preHandle 执行顺序:A → B。 postHandle 执行顺序:B → A。 afterCompletion 执行顺序:B → A。